En febrero de 2026, Gartner publicó una predicción que debería incomodar a cualquier directivo que haya apostado todo a la automatización: la mitad de las empresas que redujeron personal de atención al cliente por la IA van a recontratar personas para funciones similares antes de 2027. No es una especulación marginal. Es la firma de análisis más citada del mundo, con datos de 321 líderes de servicio al cliente, diciendo algo que contradice la narrativa dominante de los últimos tres años.

La historia es más profunda de lo que parece. No se trata de que la inteligencia artificial no funcione. Funciona. El problema es que funciona tan bien resolviendo lo rutinario que expone, con una claridad brutal, todo lo que no puede resolver. Y ese "todo lo que no puede resolver" resulta ser exactamente lo que define si un cliente se queda o se va, si confía o desconfía, si recomienda o advierte.

Esta es la paradoja de la automatización. Y entenderla no es un ejercicio filosófico: es la decisión estratégica más importante que una empresa de servicio puede tomar en 2026.

La paradoja que nadie anticipó

Hay una idea que atraviesa la historia de la tecnología como un hilo invisible. La formuló el filósofo húngaro-británico Michael Polanyi en 1966, mucho antes de que existiera algo parecido a un chatbot: "Sabemos más de lo que podemos decir." Polanyi se refería al conocimiento tácito — esa capacidad humana de hacer cosas que no podemos explicar con reglas. Reconocer un rostro entre miles. Percibir que un cliente está frustrado antes de que lo diga. Saber que esta conversación necesita un tono diferente.

Durante décadas, la paradoja de Polanyi fue un muro para la automatización. Si no puedes articular las reglas, no puedes programarlas. Los chatbots de reglas y los sistemas IVR funcionaban precisamente dentro de ese límite: hacían lo que podías especificar, y nada más.

Pero la inteligencia artificial generativa cambió la ecuación. Los modelos de lenguaje no necesitan reglas explícitas: aprenden patrones del comportamiento humano a partir de millones de ejemplos. Un estudio de la Universidad de Stanford y el MIT, publicado en el NBER, demostró que una herramienta de IA entrenada con las transcripciones de los mejores agentes de un contact center logró transferir ese conocimiento tácito al resto del equipo. El resultado: un aumento de productividad del 14% en promedio, y del 34% en los agentes novatos. Los agentes con dos meses de experiencia rindieron al nivel de los que llevaban seis meses, sin la herramienta.

Y aquí aparece la paradoja. La IA resuelve el conocimiento tácito operativo — el cómo responder, el qué información dar, el cuándo escalar. Pero al resolver eso, revela una capa más profunda de conocimiento tácito que sigue siendo exclusivamente humana: el juicio, la empatía contextual, la capacidad de leer entre líneas. Cuanto más competente es la máquina en lo técnico, más visible se vuelve lo que le falta. Y lo que le falta es, paradójicamente, lo que más importa.

El caso Klarna: anatomía de un exceso

Si la paradoja de la automatización necesitaba un caso de estudio corporativo, Klarna lo proporcionó con una generosidad involuntaria.

En 2024, la fintech sueca anunció con orgullo que su chatbot de IA — desarrollado con OpenAI — había reemplazado a 700 agentes de servicio al cliente. Los números iniciales parecían validar la decisión: el bot manejaba el 75% de los chats, procesando 2,3 millones de conversaciones en 35 idiomas. El CEO, Sebastian Siemiatkowski, convirtió la métrica en un eslogan corporativo.

Lo que no se midió — o se midió y se ignoró — fue qué pasaba con el otro 25%. Las interacciones complejas. Los clientes con problemas de reembolso que no encajaban en patrones predefinidos. Las situaciones emocionalmente cargadas donde la velocidad del bot se sentía como indiferencia. Los casos donde el cliente necesitaba sentir que alguien lo entendía, no que alguien lo procesaba.

Para principios de 2025, las métricas de satisfacción en interacciones complejas se habían deteriorado. Los clientes reportaban respuestas robóticas, scripts inflexibles, y lo que un analista describió como un "loop kafkiano": repetir el problema a un humano después de que el bot fallara, como si la primera conversación no hubiera existido.

En mayo de 2025, Siemiatkowski admitió públicamente: "Nos enfocamos demasiado en la eficiencia y el costo. El resultado fue menor calidad." Para 2026, Klarna estaba recontratando agentes humanos bajo un modelo híbrido que denominaron "estilo Uber": agentes remotos con horarios flexibles, dirigidos a estudiantes y padres.

El arco narrativo de Klarna es instructivo no por su fracaso, sino por su lógica. La empresa no cometió un error técnico. Cometió un error filosófico: confundió la capacidad de procesar con la capacidad de comprender. Automatizó la transacción, pero la transacción era solo la superficie de lo que sus clientes necesitaban.

Lo que sabemos más de lo que podemos decir

Volvamos a Polanyi, porque su idea tiene implicancias más profundas de lo que la industria tecnológica suele concederle.

Cuando un agente humano experimentado habla con un cliente furioso, está haciendo algo que ningún manual de procedimientos puede capturar completamente. Está leyendo microseñales: el ritmo de las palabras, la elección de términos, el contexto implícito. Está ajustando su tono en tiempo real, no siguiendo un script de "empatía" con frases prediseñadas. Está tomando una decisión que integra información emocional, contextual y operativa de un modo que ni siquiera el agente podría articular si le pidieras que explique exactamente qué hizo y por qué.

Esto es lo que los investigadores del MIT llaman "knowledge spillover" — el derrame de conocimiento tácito. Lo fascinante del estudio de Stanford-MIT es que la IA logró capturar parte de ese conocimiento tácito operativo y transferirlo. Pero la parte que capturó es la capa más superficial: patrones de respuesta, secuencias exitosas, estructuras de conversación. La capa profunda — la que distingue a un agente que resuelve de uno que conecta — sigue siendo opaca para la máquina.

Sherry Turkle, profesora del MIT y autora de "Alone Together", lleva dos décadas estudiando la relación entre humanos y máquinas. Su conclusión es incómoda para la industria: las máquinas pueden simular intimidad, pero la simulación no produce confianza. Produce, en el mejor de los casos, comodidad. Y en el peor, lo que ella llama "the uncanny valley of empathy" — esa sensación perturbadora de que algo pretende entenderte sin realmente hacerlo.

En atención al cliente, esta distinción no es académica. Según Harvard Business Review, los clientes forman conexiones emocionales con las marcas a través de tres dimensiones: competencia, calidez y autenticidad. La IA excele en competencia — es rápida, precisa, disponible. Pero la calidez y la autenticidad siguen siendo territorios humanos. Y lo relevante es que las tres dimensiones son necesarias. Competencia sin calidez es eficiencia fría. Calidez sin competencia es buena intención inútil. La empresa que logra las tres es la que retiene.

Los números que sostienen la paradoja

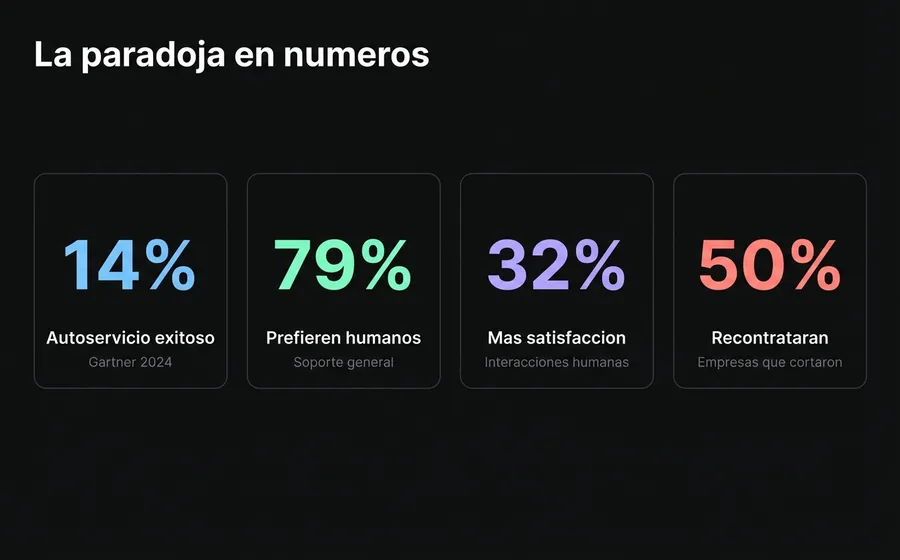

La paradoja de la automatización no es una intuición. Es una tendencia documentada con datos convergentes de múltiples fuentes:

| Hallazgo | Fuente | Año |

|---|---|---|

| Solo el 14% de los problemas de servicio se resuelven completamente en autoservicio | Gartner | 2024 |

| El 79% de los consumidores prefiere interactuar con un humano para soporte general | SurveyMonkey | 2026 |

| El 89% cree que las empresas deben siempre ofrecer la opción de hablar con una persona | Encuesta global CX | 2025 |

| El 78% dice que es importante poder escalar de un agente de IA a uno humano | Encuesta global CX | 2025 |

| Las interacciones emocionalmente cargadas resueltas por humanos generan 32% más satisfacción | McKinsey | 2025 |

| El 91% de los líderes de servicio al cliente siente presión para implementar IA | Gartner | 2026 |

| Solo el 20% de las organizaciones redujo efectivamente su plantilla de agentes gracias a la IA | Gartner | 2025 |

Leídos en conjunto, estos datos cuentan una historia coherente. Hay una presión enorme para automatizar (91% de los líderes la sienten). La automatización resuelve una fracción del problema (14% de resolución completa en autoservicio). Los clientes siguen queriendo humanos para lo que importa (79% de preferencia). Y cuando las empresas cortan agentes, la mayoría termina arrepintiéndose.

El dato más revelador es quizás el más simple: solo el 8% de los consumidores prefiere la IA sobre un humano en servicio al cliente. Entre ese 8%, las razones son disponibilidad (41%) y velocidad (37%) — ventajas operativas, no relacionales. Nadie dice "prefiero la IA porque me entiende mejor."

El último metro humano

En logística existe el concepto del "último kilómetro" — el tramo final de entrega que es, paradójicamente, el más costoso y complejo de toda la cadena. Llegar del centro de distribución a la puerta de tu casa cuesta más que mover el paquete 5.000 kilómetros por avión.

En atención al cliente, hay un equivalente que podríamos llamar el "último metro humano." Es el momento en que la conversación deja de ser un intercambio de información y se convierte en una negociación emocional. El cliente no necesita datos. Necesita sentir que su problema importa. Que la persona (o la entidad) al otro lado tiene la autoridad y la voluntad de resolverlo. Que no es un caso, es una persona.

Este último metro es donde se decide la lealtad. Y es, por definición, donde la IA tiene su mayor limitación. No porque no pueda generar frases empáticas — puede, y cada vez mejor — sino porque la empatía sin consecuencias no es empatía. Es simulación. Un humano puede decir "voy a resolver esto personalmente" y esa frase tiene peso porque hay una persona detrás que pone su reputación profesional en juego. Cuando un bot dice lo mismo, es una cadena de tokens optimizada para producir satisfacción. El cliente lo sabe. A veces conscientemente, a veces como una intuición que no puede articular.

La ironía es que cuanto mejor se vuelve la IA manejando el 80% rutinario, más alto es el estándar para ese 20% que llega a un humano. Si el bot resolvió cinco preguntas simples de manera impecable, el cliente espera que el agente humano al que finalmente llega sea excepcional. No bueno. Excepcional. La automatización no baja el estándar humano. Lo eleva.

Tres errores estratégicos de la sobre-automatización

1. Confundir resolución con satisfacción

Un ticket puede marcarse como "resuelto" cuando el bot dio la respuesta correcta. Pero resolución no es lo mismo que satisfacción, y satisfacción no es lo mismo que lealtad. Según McKinsey, las interacciones que generan conexión emocional tienen un impacto en retención 32% superior a las que simplemente resuelven el problema. La empresa que mide solo tasa de resolución está optimizando una métrica mientras erosiona otra más importante.

2. Automatizar antes de entender

Gartner advirtió en 2026 que el 40% de los proyectos de IA agéntica enfrentarán fracaso por intentar "automatizar procesos obsoletos." No puedes automatizar un proceso roto y esperar que la IA lo arregle. Si tu flujo de escalación es confuso con humanos, será confuso con bots. Si tus categorías de soporte no reflejan los problemas reales de tus clientes, un bot entrenado con esas categorías reproducirá la confusión más rápido.

La IA amplifica lo que ya existe. Si existe claridad operativa, la amplifica. Si existe caos, lo amplifica también. Antes de automatizar, hay que hacer el trabajo humano de entender qué funciona y qué no.

3. Eliminar el contexto relacional

Cuando una empresa reemplaza completamente un equipo de soporte humano, no solo elimina agentes. Elimina la red de conocimiento informal que esos agentes habían construido: quién es el cliente frecuente que siempre tiene problemas con facturación, qué tipo de solicitudes terminan en escalación, cuál es el tono que funciona con el mercado chileno versus el argentino. Ese conocimiento no está en ninguna base de datos. Vive en la experiencia colectiva del equipo. Y una vez que se pierde, no se recupera entrenando un modelo.

El modelo híbrido: ni todo humano, ni todo máquina

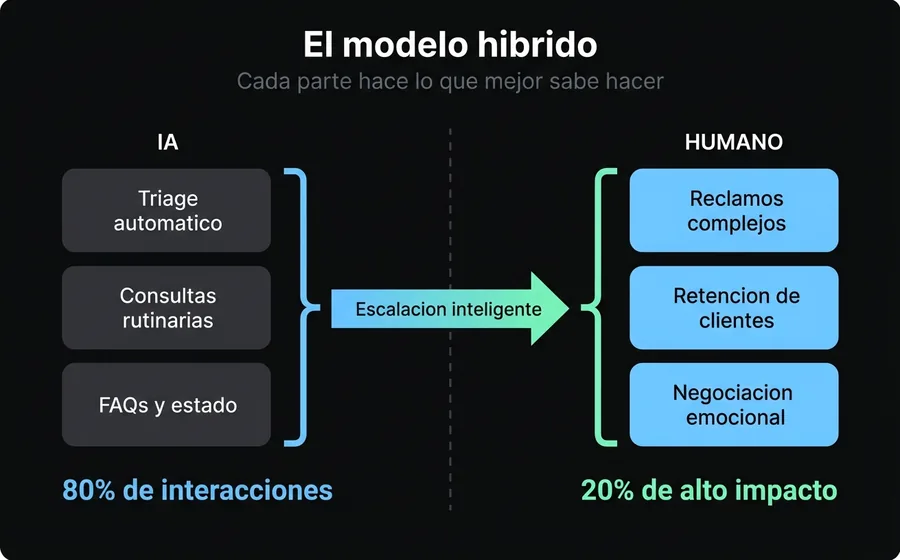

Si los datos convergen en algo, es en esto: el futuro no es IA versus humanos. Es IA con humanos, donde cada uno hace lo que mejor sabe hacer.

El estudio de Stanford-MIT ofrece la pista más concreta. La IA como herramienta de coaching — no como reemplazo — produjo mejoras medibles: 14% más productividad, 25% menos escalaciones a supervisores, mejor retención de empleados. El modelo funciona porque respeta la paradoja: usa la IA para transferir conocimiento tácito operativo, pero mantiene al humano en el centro de la interacción.

Gartner proyecta que para 2026, el 55% de las interacciones de atención al cliente será de tipo híbrido IA-humano. No IA sola, no humano solo: híbrido. La IA ejecuta con precisión, el humano aporta juicio. La IA procesa el contexto, el humano interpreta la emoción. La IA sugiere la respuesta, el humano decide si es la correcta para este cliente, en este momento, con esta historia.

Este modelo requiere un cambio de mentalidad. El agente humano en un sistema híbrido no es un operador que sigue instrucciones. Es un profesional de la relación, equipado con herramientas de IA que amplían su capacidad. Su trabajo no es responder más rápido — la máquina ya hizo eso. Su trabajo es conectar con el cliente en el momento que importa, resolver lo que la máquina no puede, y convertir un problema en una oportunidad de lealtad.

Las plataformas que entienden esto no diseñan la IA para reemplazar al agente. La diseñan para potenciarlo: sugiriendo respuestas, resumiendo el historial del cliente, detectando el sentimiento de la conversación en tiempo real, y liberándolo de lo repetitivo para que pueda dedicar su energía a lo relacional.

Implicancias para los próximos 18 meses

La IA invisible será más valiosa que la IA visible

Las empresas que más impacto van a generar no son las que ponen un bot al frente y dicen "habla con nuestra IA." Son las que integran la IA de manera invisible en el flujo de trabajo del agente humano. El cliente no necesita saber que la respuesta fue sugerida por un modelo de lenguaje. Necesita saber que fue respondido bien, rápido y con criterio.

Los agentes humanos van a ser más caros y más valiosos

Si la IA maneja el 80% de las consultas rutinarias, el 20% que queda requiere un nivel de habilidad significativamente mayor. Esto significa que las empresas necesitan invertir más en capacitación, no menos. El agente del futuro no es el que responde preguntas frecuentes — para eso está el bot. Es el que navega conversaciones difíciles, retiene clientes enojados y convierte quejas en oportunidades. Ese perfil es más escaso y más valioso.

La medición va a cambiar

Las métricas tradicionales de contact center — tiempo promedio de resolución, tickets cerrados por hora, tasa de resolución en primer contacto — están diseñadas para medir eficiencia transaccional. Son relevantes, pero incompletas. Las empresas que lideren van a medir también: sentimiento del cliente post-interacción, tasa de retención vinculada a interacciones humanas vs. automatizadas, Net Promoter Score segmentado por tipo de agente (humano, bot, híbrido), y valor de vida del cliente (CLV) por canal de resolución.

El modelo híbrido será el estándar, no la excepción

Para finales de 2027, las empresas que operan con modelo 100% automatizado o 100% humano van a ser la minoría. El estándar será un ecosistema donde la IA hace triage, resuelve lo rutinario, escala lo complejo, y el humano interviene con contexto completo y herramientas de IA como copiloto. Las plataformas que no ofrezcan esta arquitectura van a perder relevancia.

Preguntas frecuentes

¿La IA va a reemplazar a los agentes de atención al cliente?

No en la forma que se predecía. Gartner estima que la IA agéntica resolverá de forma autónoma el 80% de las consultas comunes para 2029, pero la misma Gartner predice que la mitad de las empresas que cortaron agentes van a recontratar antes de 2027. El modelo que emerge es de colaboración, no reemplazo: la IA maneja lo rutinario y el humano se enfoca en lo complejo y relacional.

¿Qué es la paradoja de la automatización en servicio al cliente?

Es el fenómeno por el cual automatizar las interacciones rutinarias no reduce la necesidad de humanos, sino que la transforma y eleva. Cuanto más eficiente es la IA resolviendo consultas simples, más alto es el estándar de calidad que los clientes esperan en las interacciones que llegan a un humano. La automatización no elimina lo humano; lo hace más visible y más valioso.

¿Por qué fracasó la estrategia de IA de Klarna?

Klarna eliminó aproximadamente 700 agentes de servicio al cliente y los reemplazó con un chatbot de IA en 2024. Si bien el bot procesó el 75% de los chats exitosamente, la satisfacción cayó en interacciones complejas. El CEO Sebastian Siemiatkowski admitió que la empresa "se enfocó demasiado en eficiencia y costo." Para 2026, estaban recontratando humanos bajo un modelo híbrido. El error no fue técnico sino estratégico: confundieron la capacidad de procesar con la capacidad de comprender.

¿Cuánto prefieren los consumidores el soporte humano sobre la IA?

El 79% de los consumidores prefiere interactuar con un humano para soporte general. Solo el 8% prefiere IA sobre humanos, y sus razones son operativas (disponibilidad y velocidad), no relacionales. Sin embargo, el 51% prefiere bots para servicio inmediato en consultas simples, lo que confirma que el modelo óptimo es híbrido.

¿Qué debería automatizar una empresa y qué no?

Automatiza lo que se puede resolver con información y un proceso claro (consultas de estado, FAQs, trámites estandarizados). Mantén humanos para lo que requiere juicio, negociación emocional o contexto relacional (reclamos, retención, ventas complejas, situaciones excepcionales). El criterio no es "¿la IA puede hacerlo?" sino "¿el cliente necesita sentir que hay una persona?" Si la respuesta es sí, la IA debería ser el copiloto, no el piloto.

Conclusión

La paradoja de la automatización no es un problema técnico que se resuelve con un modelo más avanzado. Es una verdad sobre la naturaleza humana: valoramos lo que sentimos que es auténtico, y la autenticidad no se escala con servidores. La IA es la herramienta más poderosa que ha llegado al servicio al cliente en décadas. Pero como toda herramienta poderosa, su valor no está en lo que puede hacer sola, sino en cómo amplifica lo que hacen las personas.

Las empresas que van a liderar los próximos años no son las que automatizan más. Son las que automatizan mejor — liberando a sus equipos humanos de lo repetitivo para que se concentren en lo que ninguna máquina puede replicar: la capacidad de hacer sentir a otro ser humano que su problema importa.

Eso no es sentimentalismo. Es estrategia. Y los datos lo confirman.