Em fevereiro de 2026, a Gartner publicou uma previsão que deveria incomodar qualquer diretor que tenha apostado tudo na automação: metade das empresas que reduziram pessoal de atendimento ao cliente por causa da IA vão recontratar pessoas para funções semelhantes antes de 2027. Não é uma especulação marginal. É a empresa de análise mais citada do mundo, com dados de 321 líderes de atendimento ao cliente, dizendo algo que contradiz a narrativa dominante dos últimos três anos.

A história é mais profunda do que parece. Não se trata de que a inteligência artificial não funcione. Funciona. O problema é que funciona tão bem resolvendo o rotineiro que expõe, com uma clareza brutal, tudo o que não consegue resolver. E esse "tudo o que não consegue resolver" acaba sendo exatamente o que define se um cliente fica ou vai embora, se confia ou desconfia, se recomenda ou adverte.

Este é o paradoxo da automação. E entendê-la não é um exercício filosófico: é a decisão estratégica mais importante que uma empresa de serviço pode tomar em 2026.

O paradoxo que ninguém antecipou

Há uma ideia que atravessa a história da tecnologia como um fio invisível. Ela foi formulada pelo filósofo húngaro-britânico Michael Polanyi em 1966, muito antes que existisse algo parecido com um chatbot: "Sabemos mais do que podemos dizer." Polanyi referia-se ao conhecimento tácito — essa capacidade humana de fazer coisas que não podemos explicar com regras. Reconhecer um rosto entre milhares. Perceber que um cliente está frustrado antes que ele diga. Saber que esta conversa precisa de um tom diferente.

Durante décadas, o paradoxo de Polanyi foi um muro para a automação. Se você não consegue articular as regras, não consegue programá-las. Os chatbots de regras e os sistemas IVR funcionavam precisamente dentro desse limite: faziam o que você podia especificar, e nada mais.

Mas a inteligência artificial generativa mudou a equação. Os modelos de linguagem não precisam de regras explícitas: aprendem padrões do comportamento humano a partir de milhões de exemplos. Um estudo da Universidade de Stanford e do MIT, publicado no NBER, demonstrou que uma ferramenta de IA treinada com as transcrições dos melhores agentes de um contact center conseguiu transferir esse conhecimento tácito para o resto da equipe. O resultado: um aumento de produtividade de 14% em média, e de 34% nos agentes novatos. Os agentes com dois meses de experiência renderam ao nível dos que tinham seis meses, sem a ferramenta.

E aqui aparece o paradoxo. A IA resolve o conhecimento tácito operacional — o como responder, o que informação dar, o quando escalar. Mas ao resolver isso, revela uma camada mais profunda de conhecimento tácito que continua sendo exclusivamente humana: o julgamento, a empatia contextual, a capacidade de ler nas entrelinhas. Quanto mais competente é a máquina no aspecto técnico, mais visível se torna o que lhe falta. E o que lhe falta é, paradoxalmente, o que mais importa.

O caso Klarna: anatomia de um excesso

Se o paradoxo da automação precisava de um estudo de caso corporativo, a Klarna o forneceu com uma generosidade involuntária.

Em 2024, a fintech sueca anunciou com orgulho que seu chatbot de IA — desenvolvido com OpenAI — havia substituído 700 agentes de atendimento ao cliente. Os números iniciais pareciam validar a decisão: o bot lidava com 75% dos chats, processando 2,3 milhões de conversas em 35 idiomas. O CEO, Sebastian Siemiatkowski, transformou a métrica em um slogan corporativo.

O que não foi medido — ou foi medido e ignorado — foi o que acontecia com os outros 25%. As interações complexas. Os clientes com problemas de reembolso que não se encaixavam em padrões predefinidos. As situações emocionalmente carregadas onde a velocidade do bot era sentida como indiferença. Os casos onde o cliente precisava sentir que alguém o entendia, não que alguém o processava.

No início de 2025, as métricas de satisfação em interações complexas haviam se deteriorado. Os clientes relatavam respostas robóticas, scripts inflexíveis, e o que um analista descreveu como um "loop kafkiano": repetir o problema a um humano depois que o bot falhava, como se a primeira conversa não tivesse existido.

Em maio de 2025, Siemiatkowski admitiu publicamente: "Nós nos concentramos demais na eficiência e no custo. O resultado foi menor qualidade." Em 2026, a Klarna estava recontratando agentes humanos sob um modelo híbrido que denominaram "estilo Uber": agentes remotos com horários flexíveis, direcionados a estudantes e pais.

O arco narrativo da Klarna é instrutivo não pelo seu fracasso, mas pela sua lógica. A empresa não cometeu um erro técnico. Cometeu um erro filosófico: confundiu a capacidade de processar com a capacidade de compreender. Automatizou a transação, mas a transação era apenas a superfície do que seus clientes precisavam.

O que sabemos mais do que podemos dizer

Voltemos a Polanyi, porque sua ideia tem implicações mais profundas do que a indústria tecnológica costuma conceder.

Quando um agente humano experiente fala com um cliente furioso, está fazendo algo que nenhum manual de procedimentos pode capturar completamente. Está lendo microssinais: o ritmo das palavras, a escolha de termos, o contexto implícito. Está ajustando seu tom em tempo real, não seguindo um script de "empatia" com frases pré-projetadas. Está tomando uma decisão que integra informações emocionais, contextuais e operacionais de um modo que nem mesmo o agente conseguiria articular se você pedisse para ele explicar exatamente o que fez e por quê.

Isso é o que os pesquisadores do MIT chamam de "knowledge spillover" — o derramamento de conhecimento tácito. O fascinante do estudo de Stanford-MIT é que a IA conseguiu capturar parte desse conhecimento tácito operacional e transferi-lo. Mas a parte que capturou é a camada mais superficial: padrões de resposta, sequências bem-sucedidas, estruturas de conversação. A camada profunda — aquela que distingue um agente que resolve de um que conecta — continua sendo opaca para a máquina.

Sherry Turkle, professora do MIT e autora de "Alone Together", há duas décadas estuda a relação entre humanos e máquinas. Sua conclusão é incômoda para a indústria: as máquinas podem simular intimidade, mas a simulação não produz confiança. Produz, na melhor das hipóteses, conforto. E na pior, o que ela chama de "the uncanny valley of empathy" — aquela sensação perturbadora de que algo finge te entender sem realmente fazê-lo.

Em atendimento ao cliente, essa distinção não é acadêmica. Segundo a Harvard Business Review, os clientes formam conexões emocionais com as marcas através de três dimensões: competência, acolhimento e autenticidade. A IA se destaca em competência — é rápida, precisa, disponível. Mas o acolhimento e a autenticidade continuam sendo territórios humanos. E o relevante é que as três dimensões são necessárias. Competência sem acolhimento é eficiência fria. Acolhimento sem competência é boa intenção inútil. A empresa que alcança as três é a que retém.

Os números que sustentam o paradoxo

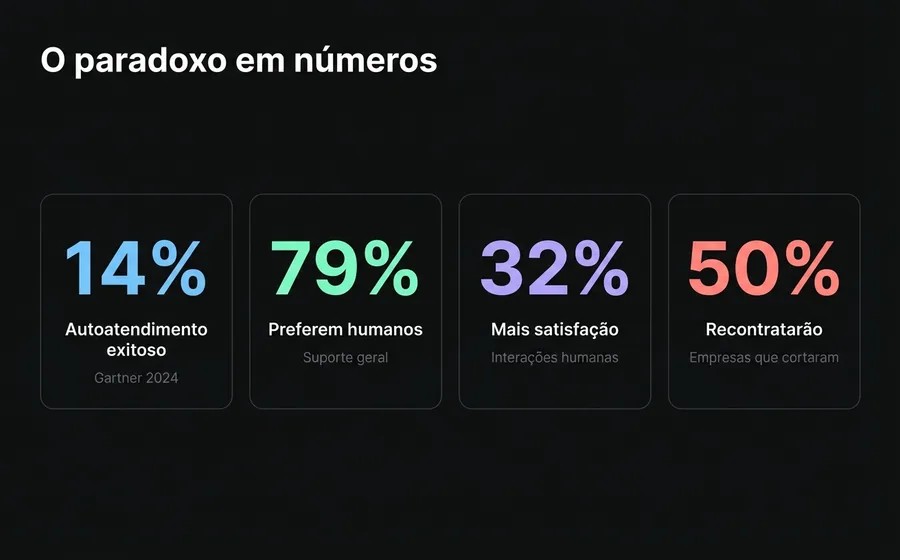

O paradoxo da automação não é uma intuição. É uma tendência documentada com dados convergentes de múltiplas fontes:

| Constatação | Fonte | Ano |

|---|---|---|

| Apenas 14% dos problemas de serviço são resolvidos completamente em autoatendimento | Gartner | 2024 |

| 79% dos consumidores prefere interagir com um humano para suporte geral | SurveyMonkey | 2026 |

| 89% acredita que as empresas devem sempre oferecer a opção de falar com uma pessoa | Pesquisa global CX | 2025 |

| 78% diz que é importante poder escalar de um agente de IA para um humano | Pesquisa global CX | 2025 |

| As interações emocionalmente carregadas resolvidas por humanos geram 32% mais satisfação | McKinsey | 2025 |

| 91% dos líderes de serviço ao cliente sente pressão para implementar IA | Gartner | 2026 |

| Apenas 20% das organizações reduziu efetivamente sua equipe de agentes graças à IA | Gartner | 2025 |

Lidos em conjunto, esses dados contam uma história coerente. Há uma pressão enorme para automatizar (91% dos líderes a sentem). A automação resolve uma fração do problema (14% de resolução completa em autoatendimento). Os clientes continuam querendo humanos para o que importa (79% de preferência). E quando as empresas cortam agentes, a maioria acaba se arrependendo.

O dado mais revelador é talvez o mais simples: apenas 8% dos consumidores prefere a IA sobre um humano em serviço ao cliente. Entre esses 8%, as razões são disponibilidade (41%) e velocidade (37%) — vantagens operacionais, não relacionais. Ninguém diz "prefiro a IA porque me entende melhor."

O último metro humano

Em logística existe o conceito do "último quilômetro" — o trecho final de entrega que é, paradoxalmente, o mais custoso e complexo de toda a cadeia. Chegar do centro de distribuição à porta da sua casa custa mais do que mover o pacote 5.000 quilômetros por avião.

Em atendimento ao cliente, há um equivalente que poderíamos chamar de "último metro humano." É o momento em que a conversa deixa de ser uma troca de informações e se torna uma negociação emocional. O cliente não precisa de dados. Precisa sentir que seu problema importa. Que a pessoa (ou a entidade) do outro lado tem a autoridade e a vontade de resolvê-lo. Que não é um caso, é uma pessoa.

Este último metro é onde se decide a lealdade. E é, por definição, onde a IA tem sua maior limitação. Não porque não possa gerar frases empáticas — pode, e cada vez melhor — mas porque a empatia sem consequências não é empatia. É simulação. Um humano pode dizer "vou resolver isso pessoalmente" e essa frase tem peso porque há uma pessoa por trás que coloca sua reputação profissional em jogo. Quando um bot diz o mesmo, é uma cadeia de tokens otimizada para produzir satisfação. O cliente sabe disso. Às vezes conscientemente, às vezes como uma intuição que não consegue articular.

A ironia é que quanto melhor a IA se torna ao lidar com os 80% rotineiros, mais alto é o padrão para os 20% que chegam a um humano. Se o bot resolveu cinco perguntas simples de forma impecável, o cliente espera que o agente humano ao qual ele finalmente chega seja excepcional. Não bom. Excepcional. A automação não diminui o padrão humano. Ela o eleva.

Três erros estratégicos da sobre-automação

1. Confundir resolução com satisfação

Um ticket pode ser marcado como "resolvido" quando o bot deu a resposta correta. Mas resolução não é o mesmo que satisfação, e satisfação não é o mesmo que lealdade. Segundo a McKinsey, as interações que geram conexão emocional têm um impacto na retenção 32% superior às que simplesmente resolvem o problema. A empresa que mede apenas a taxa de resolução está otimizando uma métrica enquanto erode outra mais importante.

2. Automatizar antes de entender

Gartner alertou em 2026 que 40% dos projetos de IA agêntica enfrentarão o fracasso por tentar "automatizar processos obsoletos." Você não pode automatizar um processo quebrado e esperar que a IA o conserte. Se o seu fluxo de escalonamento é confuso com humanos, será confuso com bots. Se suas categorias de suporte não refletem os problemas reais de seus clientes, um bot treinado com essas categorias reproduzirá a confusão mais rapidamente.

A IA amplifica o que já existe. Se existe clareza operacional, ela a amplifica. Se existe caos, ela o amplifica também. Antes de automatizar, é preciso fazer o trabalho humano de entender o que funciona e o que não funciona.

3. Eliminar o contexto relacional

Quando uma empresa substitui completamente uma equipe de suporte humano, não apenas elimina agentes. Ela elimina a rede de conhecimento informal que esses agentes haviam construído: quem é o cliente frequente que sempre tem problemas com faturamento, que tipo de solicitações terminam em escalonamento, qual é o tom que funciona com o mercado chileno versus o argentino. Esse conhecimento não está em nenhuma base de dados. Ele vive na experiência coletiva da equipe. E uma vez que se perde, não se recupera treinando um modelo.

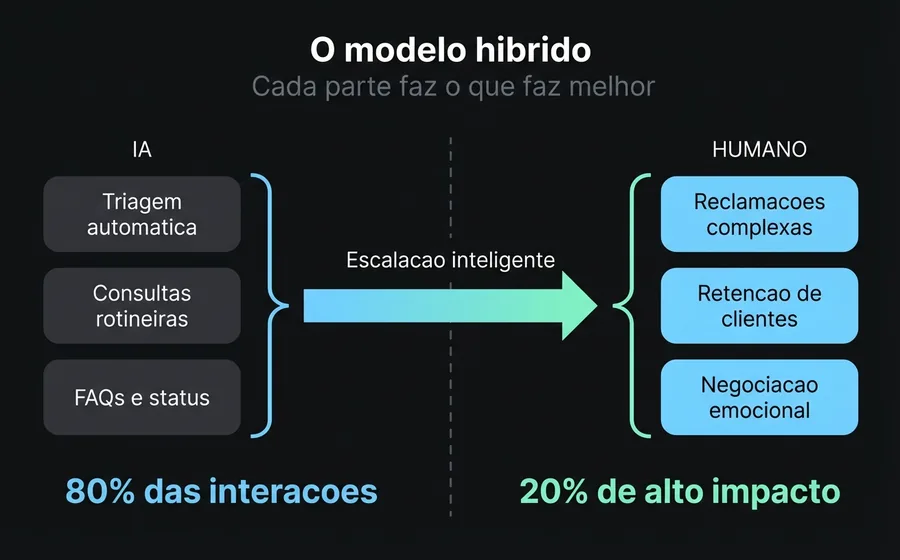

O modelo híbrido: nem tudo humano, nem tudo máquina

Se os dados convergem em algo, é nisto: o futuro não é IA versus humanos. É IA com humanos, onde cada um faz o que melhor sabe fazer.

O estudo de Stanford-MIT oferece a pista mais concreta. A IA como ferramenta de coaching — não como substituição — produziu melhorias mensuráveis: 14% mais produtividade, 25% menos escalonamentos para supervisores, melhor retenção de funcionários. O modelo funciona porque respeita o paradoxo: usa a IA para transferir conhecimento tácito operacional, mas mantém o humano no centro da interação.

Gartner projeta que, para 2026, 55% das interações de atendimento ao cliente serão do tipo híbrido IA-humano. Não IA sozinha, não humano sozinho: híbrido. A IA executa com precisão, o humano contribui com julgamento. A IA processa o contexto, o humano interpreta a emoção. A IA sugere a resposta, o humano decide se é a correta para este cliente, em este momento, com esta história.

Este modelo requer uma mudança de mentalidade. O agente humano em um sistema híbrido não é um operador que segue instruções. É um profissional de relacionamento, equipado com ferramentas de IA que ampliam sua capacidade. Seu trabalho não é responder mais rápido — a máquina já fez isso. Seu trabalho é conectar com o cliente no momento que importa, resolver o que a máquina não pode, e converter um problema em uma oportunidade de lealdade.

As plataformas que entendem isso não projetam a IA para substituir o agente. Elas a projetam para potenciá-lo: sugerindo respostas, resumindo o histórico do cliente, detectando o sentimento da conversa em tempo real, e liberando-o do repetitivo para que possa dedicar sua energia ao relacional.

Implicações para os próximos 18 meses

A IA invisível será mais valiosa que a IA visível

As empresas que mais impacto vão gerar não são as que colocam um bot na frente e dizem "fale com nossa IA." São as que integram a IA de maneira invisível no fluxo de trabalho do agente humano. O cliente não precisa saber que a resposta foi sugerida por um modelo de linguagem. Precisa saber que foi respondido bem, rápido e com critério.

Os agentes humanos vão ser mais caros e mais valiosos

Se a IA gerencia 80% das consultas rotineiras, os 20% restantes exigem um nível de habilidade significativamente maior. Isso significa que as empresas precisam investir mais em treinamento, não menos. O agente do futuro não é o que responde perguntas frequentes — para isso existe o bot. É o que navega conversas difíceis, retém clientes insatisfeitos e converte reclamações em oportunidades. Esse perfil é mais escasso e mais valioso.

A medição vai mudar

As métricas tradicionais de contact center — tempo médio de resolução, tickets fechados por hora, taxa de resolução no primeiro contato — são projetadas para medir eficiência transacional. São relevantes, mas incompletas. As empresas que liderarem vão medir também: sentimento do cliente pós-interação, taxa de retenção vinculada a interações humanas vs. automatizadas, Net Promoter Score segmentado por tipo de agente (humano, bot, híbrido), e valor de vida do cliente (CLV) por canal de resolução.

O modelo híbrido será o padrão, não a exceção

Até o final de 2027, as empresas que operam com modelo 100% automatizado ou 100% humano serão a minoria. O padrão será um ecossistema onde a IA faz triagem, resolve o rotineiro, escala o complexo, e o humano intervém com contexto completo e ferramentas de IA como copiloto. As plataformas que não oferecerem esta arquitetura vão perder relevância.

Perguntas frequentes

A IA vai substituir os agentes de atendimento ao cliente?

Não da forma que se previa. Gartner estima que a IA agêntica resolverá de forma autônoma 80% das consultas comuns até 2029, mas a mesma Gartner prevê que metade das empresas que cortaram agentes vai recontratar antes de 2027. O modelo que emerge é de colaboração, não substituição: a IA gerencia o rotineiro e o humano se concentra no complexo e relacional.

O que é o paradoxo da automação no atendimento ao cliente?

É o fenômeno pelo qual automatizar as interações rotineiras não reduz a necessidade de humanos, mas a transforma e eleva. Quanto mais eficiente a IA é resolvendo consultas simples, mais alto é o padrão de qualidade que os clientes esperam nas interações que chegam a um humano. A automação não elimina o humano; ela o torna mais visível e mais valioso.

Por que a estratégia de IA da Klarna falhou?

Klarna eliminou aproximadamente 700 agentes de atendimento ao cliente e os substituiu por um chatbot de IA em 2024. Embora o bot tenha processado 75% dos chats com sucesso, a satisfação caiu em interações complexas. O CEO Sebastian Siemiatkowski admitiu que a empresa "se focou demais em eficiência e custo." Até 2026, estavam recontratando humanos sob um modelo híbrido. O erro não foi técnico, mas estratégico: confundiram a capacidade de processar com a capacidade de compreender.

Quanto os consumidores preferem o suporte humano em relação à IA?

79% dos consumidores prefere interagir com um humano para suporte geral. Apenas 8% prefere IA em vez de humanos, e suas razões são operacionais (disponibilidade e velocidade), não relacionais. No entanto, 51% prefere bots para serviço imediato em consultas simples, o que confirma que o modelo ideal é híbrido.

O que uma empresa deve automatizar e o que não deve?

Automatize o que pode ser resolvido com informação e um processo claro (consultas de status, FAQs, trâmites padronizados). Mantenha humanos para o que exige julgamento, negociação emocional ou contexto relacional (reclamações, retenção, vendas complexas, situações excepcionais). O critério não é "a IA pode fazer isso?" mas "o cliente precisa sentir que há uma pessoa?" Se a resposta for sim, a IA deve ser o copiloto, não o piloto.

Conclusão

O paradoxo da automação não é um problema técnico que se resolve com um modelo mais avançado. É uma verdade sobre a natureza humana: valorizamos o que sentimos ser autêntico, e a autenticidade não escala com servidores. A IA é a ferramenta mais poderosa que chegou ao atendimento ao cliente em décadas. Mas como toda ferramenta poderosa, seu valor não está no que ela pode fazer sozinha, mas em como amplifica o que as pessoas fazem.

As empresas que vão liderar nos próximos anos não são as que automatizam mais. São as que automatizam melhor — liberando suas equipes humanas do repetitivo para que se concentrem no que nenhuma máquina pode replicar: a capacidade de fazer outro ser humano sentir que seu problema importa.

Isso não é sentimentalismo. É estratégia. E os dados confirmam isso.