En febrero de 2024, el CEO de Klarna anunció con orgullo que su Agente de IA — desarrollado con OpenAI — había hecho el trabajo de 700 agentes humanos en su primer mes. Procesó 2,3 millones de conversaciones, redujo el tiempo de resolución de 11 minutos a menos de 2, y le iba a ahorrar a la fintech sueca 40 millones de dólares en 2024. La cobertura tech fue eufórica. El CEO declaró públicamente que "la IA ya puede hacer todos los trabajos que hacemos los humanos". 18 meses después, Klarna está volviendo a contratar humanos.

No por arrepentimiento moral. Por un problema de calidad medible que el dashboard inicial no mostraba.

Este post no es una columna de opinión. Es el análisis operacional de qué pasó dentro de Klarna, qué patrones del mismo error vemos repetirse en operaciones LATAM, y qué arquitectura concreta funciona en la práctica para evitar el mismo destino. La razón por la que merece un post propio — y no solo un párrafo — es que el caso Klarna es el primer ejemplo público y documentado de una empresa que apostó "todo a la IA" en atención al cliente, midió los resultados con honestidad y revirtió la decisión. La industria entera está mirando cómo termina esta historia para decidir su propio próximo movimiento.

Acto 1: la promesa de febrero de 2024

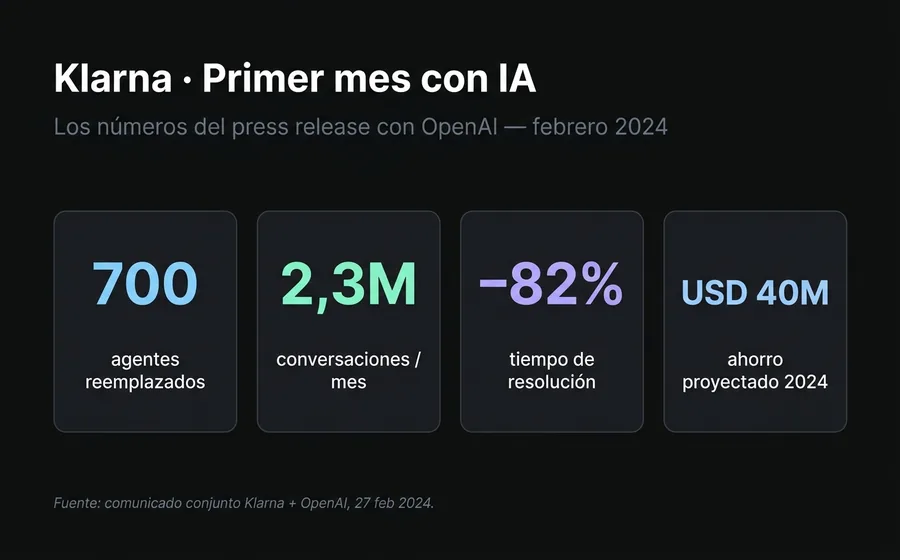

El 27 de febrero de 2024, Klarna y OpenAI publicaron un comunicado conjunto. Los números del primer mes del Agente de IA en producción eran difíciles de ignorar:

- 2,3 millones de conversaciones procesadas en 30 días

- Dos tercios de todas las consultas de servicio al cliente

- Tiempo de resolución promedio: menos de 2 minutos, comparado con 11 minutos antes

- 25% menos consultas repetidas, lo que indicaba que las respuestas resolvían en el primer contacto

- 23 mercados, 35+ idiomas desde el día uno

- Proyección de impacto: USD 40 millones en mejora de utilidad para 2024

Brad Lightcap, COO de OpenAI en ese momento, lo selló con una declaración: "Klarna está al frente entre nuestros partners en adopción y aplicación práctica de IA". Sebastian Siemiatkowski, CEO de Klarna, fue todavía más lejos en entrevistas: "La IA ya puede hacer todos los trabajos que hacemos los humanos."

Es importante entender por qué la promesa era creíble en ese momento. Los números iniciales eran reales. El bot estaba funcionando. La satisfacción promedio era comparable a la de los agentes humanos. Klarna no estaba mintiendo — estaba presentando los datos que tenía con la interpretación más optimista posible.

El error no estuvo en la presentación. Estuvo en qué dato se eligió mirar.

Acto 2: la degradación silenciosa

Lo que el dashboard de Klarna mostraba era el promedio. Lo que escondía era la distribución.

Cuando una empresa de servicios financieros maneja 2,3 millones de conversaciones por mes, la mayoría de esas consultas son rutinarias: "¿cuánto debo?", "¿cuándo es la próxima cuota?", "¿cómo cambio mi tarjeta?". Para esas preguntas, un Agente de IA bien construido responde mejor que un humano. Es más rápido, más consistente, no se cansa, no se equivoca por distracción. Klarna no se equivocó en ese diagnóstico.

El problema empezó a aparecer en lo que estadísticamente era invisible — el 5-10% de los casos complejos. Los reembolsos disputados. Los cobros incorrectos. Los planes de pago en hardship. Los casos de fraude. Las situaciones donde el cliente llega frustrado, con poco margen emocional, y un detalle mal contestado puede escalar a queja regulatoria.

Tres patrones se documentaron en los meses siguientes:

Hallucinations en políticas de fees y reembolsos. El Agente de IA de Klarna respondía con seguridad sobre términos que no se le habían cargado correctamente, o que habían cambiado entre versiones. En una empresa de e-commerce, una respuesta incorrecta sobre un cupón es un inconveniente. En una fintech, una respuesta incorrecta sobre un cargo o una fecha de vencimiento es un problema de cumplimiento.

Caída de CSAT en casos complejos. El promedio se mantenía estable porque los casos rutinarios eran tantos que escondían el deterioro. Pero cuando se segmentaba por complejidad, los casos que escalaban a humano después de pasar por el bot mostraban niveles de satisfacción significativamente peores que los que iban directo a humano. La razón: el cliente repetía toda la información, sentía que el bot le había hecho perder el tiempo, y llegaba al humano ya enojado.

Aumento de Customer Effort Score. La métrica que mide cuánto esfuerzo le cuesta al cliente resolver su problema empezó a subir mes a mes. Al principio era atribuible al cambio. Cuando la curva no se aplanó, quedó claro que era un patrón estructural, no transitorio.

El Better Business Bureau acumuló más de 900 quejas formales contra Klarna en tres años, la mayoría sobre temas de reembolso y facturación — exactamente el cuadrante donde una respuesta confidente pero incorrecta hace más daño que el silencio.

Para mediados de 2025, el equipo interno de Klarna empezó a contratar agentes humanos otra vez. Sin anuncio público. Sin contramarcha visible. Solo una corrección de curso silenciosa.

Acto 3: el reversal

El silencio terminó en mayo de 2025. Siemiatkowski habló con Bloomberg y dijo, en frase que quedó como punto de inflexión de toda una época de la industria: "Fuimos demasiado lejos."

Las palabras textuales del CEO en esa entrevista y las que siguieron dibujan un mapa del error:

"Nos enfocamos demasiado en costo. El resultado fue menor calidad."

"Desde la perspectiva de marca, desde la perspectiva de la empresa, creo que es crítico que seas claro con tu cliente: siempre va a haber un humano si lo quieres."

El nuevo modelo que Klarna anunció no es un retorno al call center tradicional. Es híbrido. La empresa describió el formato como "estilo Uber": agentes humanos remotos con horarios flexibles, mayormente estudiantes y padres con disponibilidad parcial, equipados con herramientas de IA que los asisten en cada conversación. La IA sigue manejando el grueso del volumen rutinario. Los humanos toman lo complejo, lo emocional y lo que requiere juicio.

Es importante notar la diferencia con la narrativa "la IA no sirve". Klarna no dijo eso. Klarna dijo "la IA sirve, pero no para todo, y el costo de descubrir dónde no sirve resultó ser más alto que lo que ahorramos". Esa distinción es la que define qué empresas van a sobrevivir el ciclo y cuáles van a estar haciendo el mismo anuncio en 2027.

Por qué pasó: los 3 errores estructurales

El caso Klarna no es un fracaso técnico. La tecnología funcionó. Lo que falló fue la lógica de evaluación. Tres errores se repiten cuando se analiza qué pasó.

Error 1: confundir deflection con resolution

El deflection rate mide qué porcentaje de consultas no llegan a un humano. El resolution rate mide qué porcentaje de problemas del cliente quedan efectivamente resueltos. No son lo mismo.

Un Agente de IA puede tener 85% de deflection y 60% de resolution. Eso significa que de cada 100 consultas, 85 no escalaron a humano — pero solo 60 se resolvieron. Los otros 25 se cerraron sin resolver: el cliente se rindió, o usó un canal alternativo, o simplemente abandonó.

El dashboard de Klarna mostraba deflection. La realidad del cliente era resolution. Cuando los dos números divergen, el primero engaña al segundo.

Error 2: ignorar la paradoja de Polanyi

Hace 30 días publicamos un análisis sobre la paradoja de la automatización, inspirado en la idea del filósofo Michael Polanyi: "sabemos más de lo que podemos decir". Hay conocimiento humano que no se puede articular en reglas — saber leer la frustración de un cliente antes de que la diga, percibir cuándo una respuesta correcta es la respuesta equivocada, ajustar el tono en tiempo real.

La IA generativa capturó parte de ese conocimiento tácito al aprender de millones de conversaciones. Pero capturó la capa superficial — los patrones de respuesta. La capa profunda — el juicio contextual — sigue siendo humana. Klarna automatizó la capa superficial creyendo que había automatizado todo. La diferencia se vio en los casos límite, que son justo los que más importan en una fintech.

Error 3: subestimar el costo de las respuestas confidentes pero erróneas en compliance

Hay industrias donde una respuesta incorrecta tiene costo bajo. Si un Agente de IA de un servicio de delivery responde mal sobre el horario de atención, el cliente se molesta y el caso se cierra. Hay otras industrias donde la misma respuesta incorrecta puede generar una multa regulatoria, un reclamo formal o un caso legal.

Cobranzas en fintech, seguros, salud, créditos al consumo: todos son cuadrantes donde la velocidad y la confianza con la que el bot responde mal son proporcionalmente dañinas. En LATAM esto se amplifica por la regulación de Defensa del Consumidor — un mensaje mal redactado puede ser usado como evidencia en un reclamo.

Klarna está en exactamente ese cuadrante. Buy now, pay later. Cargos. Fechas de vencimiento. Disputas. La empresa eligió la vertical de mayor riesgo para hacer el experimento más radical.

Lo que estamos viendo en LATAM

Como operadores de una plataforma de atención al cliente con cientos de cuentas activas en América Latina, vemos el patrón Klarna repetirse en miniatura cada mes. Es lo suficientemente consistente para describirlo como un anti-patrón.

La secuencia típica es esta. Una empresa decide automatizar atención. En el primer trimestre, el deflection rate sube de 60% a 85%. El equipo celebra. En el segundo trimestre, alguien nota que el CSAT bajó 1,5 puntos pero está dentro de la varianza estadística. En el tercer trimestre, las quejas en redes sociales suben. En el cuarto trimestre, el equipo de operaciones reporta que el % de re-contactos — el cliente que vuelve por el mismo problema — subió 18 puntos. Para entonces, el costo del deterioro de marca ya superó lo que se ahorró en headcount.

Lo que en Klarna pasó a escala global, en una empresa LATAM de 100 mil clientes pasa a escala local. La forma de la curva es la misma.

Hay tres particularidades regionales que conviene marcar:

Mayor expectativa de "humano cuando lo necesito". En LATAM, la cultura de atención al cliente tiene una fricción más baja con escalar a humano. El cliente argentino o mexicano que ve el botón "hablar con una persona" lo usa más rápido que el europeo. Esto tiene implicancia operativa: si tu Agente de IA esconde el handoff, lo penalizas más fuerte que en otros mercados.

Verticales compliance más expuestos. Argentina y Brasil tienen regulación de defensa del consumidor activa. Una conversación de WhatsApp con respuesta incorrecta sobre un cargo o un cobro puede ser presentada como evidencia formal. La barra de calidad en respuesta no es "satisfacer al cliente". Es "no exponer a la empresa a una multa".

Adopción acelerada de WhatsApp como canal principal. El 80% de las primeras interacciones comerciales en LATAM ocurren por mensajería. El error de Klarna en chat web se amplifica en WhatsApp porque la conversación queda en el teléfono del cliente como evidencia, capturable, compartible y reproducible en redes sociales si sale mal.

Las 3 lecciones operacionales

Si Klarna nos dejó algo, son tres reglas accionables. Las aplicamos en producción y las recomendamos a cualquier empresa que esté evaluando hoy reemplazo total con IA.

Lección 1: el handoff es la métrica que define si tu Agente de IA funciona

No el deflection. No la velocidad. El handoff.

Un buen sistema híbrido se reconoce porque: (a) cuando el bot escala a humano, lo hace con la conversación entera transferida — el cliente no repite información; (b) el SLA post-handoff es realista, no "en breve"; (c) el agente humano ve el contexto, las sugerencias del bot, y decide en segundos.

Si tu plataforma actual no te permite medir handoff timing, handoff completion rate y resolution rate post-handoff, estás midiendo el dashboard de Klarna en febrero de 2024.

Lección 2: híbrido > IA pura, en cualquier vertical con compliance o emoción

Esto no es una elección filosófica. Es una elección de riesgo. Una IA pura es eficiente cuando el costo del error es bajo. En cuanto el costo del error sube — multas regulatorias, daño de marca, abandono de cliente — el modelo híbrido domina.

En la arquitectura que recomendamos, un módulo NLP maneja flujos predecibles (consulta de saldo, agendamiento, FAQs). Un módulo GPT con base de conocimiento propia maneja consultas abiertas que requieren entendimiento contextual. Un Copilot asiste al agente humano cuando la conversación escala. Y una bandeja unificada con routing garantiza que el handoff sea instantáneo y con contexto preservado.

Lección 3: las verticales con compliance requieren guardrails específicos, no más entrenamiento

Cuando la respuesta incorrecta puede generar una multa, el problema no se resuelve con "más datos de entrenamiento". Se resuelve con guardrails: respuestas pre-aprobadas para temas de cargo, fee, refund y disputa; escalation automática a humano cuando aparecen palabras clave de reclamo legal; logging total de la conversación con timestamping para auditoría.

La arquitectura de tres capas de conocimiento — prompt oculto, base de conocimiento, interacciones específicas — es justamente el framework que permite definir esos guardrails sin que el bot pierda fluidez en lo no-sensible.

Cómo se ve un sistema híbrido bien construido

Para que la lección sea accionable, conviene aterrizar la arquitectura. Un sistema híbrido bien hecho tiene tres componentes y un protocolo.

Componente 1: el frontline automatizado. Aquí entra el grueso del volumen. Consultas rutinarias, FAQs, procesos transaccionales conocidos. Un módulo NLP cubre lo predecible con precisión y velocidad. Un módulo GPT con base de conocimiento propia cubre lo abierto pero acotado al dominio del negocio. Lo importante: este nivel nunca maneja lo que tiene riesgo de compliance sin escalation explícita.

Componente 2: el Copilot del agente humano. Cuando la conversación escala, el humano que la recibe no entra a ciegas. Ve la transcripción completa, un resumen automático del contexto, sugerencias de respuesta basadas en casos similares anteriores, y datos del cliente cargados desde el CRM. La velocidad del humano híbrido se acerca a la del bot, pero con juicio incorporado.

Componente 3: la bandeja unificada con routing. El cliente no sabe — ni le importa — si la respuesta vino del bot, del Copilot o del humano puro. Para él es una conversación continua. Detrás, el sistema rutea cada turno al recurso correcto: bot para preguntas conocidas, humano para casos sensibles, Copilot para humano asistido.

El protocolo: medición end-to-end. Cada conversación se mide en cinco puntos. (1) tiempo a primera respuesta, (2) número de turnos hasta resolución o handoff, (3) si hubo handoff, calidad del transfer (¿el cliente repitió info?), (4) resolution rate al cierre, (5) satisfacción a 24 horas post-cierre. Si alguno de estos cinco se degrada y los demás se mantienen, ya sabes dónde está el problema.

Esto no es una arquitectura conceptual. Es lo que está corriendo hoy en cuentas LATAM con volúmenes mensuales que van desde 5 mil hasta 500 mil conversaciones.

¿Significa que la IA no sirve?

No. Y conviene decirlo claro porque la cobertura tech está oscilando del entusiasmo de 2024 al pesimismo simétrico de 2026, y ambos extremos son incorrectos.

La IA generativa en atención al cliente funciona. Resuelve volúmenes que antes eran impensables. Reduce tiempos de respuesta de minutos a segundos. Permite ofrecer atención 24/7 sin un costo operativo prohibitivo. Captura conocimiento tácito y lo distribuye al equipo.

Lo que no funciona es el modelo de reemplazo total. Y no porque la IA sea mala, sino porque la atención al cliente no es solo procesamiento de información — es también gestión de la confianza, de la emoción y del riesgo. Cuando una empresa intenta automatizar ese segundo nivel sin conservar humanos, lo que se ahorra en costos operativos se pierde en valor de marca y en exposición regulatoria.

Klarna no fracasó por usar IA. Fracasó por usarla en lugar de humanos en vez de junto con humanos. La diferencia entre las dos preposiciones — "en lugar de" vs "junto con" — es la diferencia entre el comunicado de febrero de 2024 y la entrevista a Bloomberg en mayo de 2025.

Las empresas que van a liderar los próximos años son las que aprendieron del experimento ajeno antes de tener que pagar el suyo.

Preguntas frecuentes

¿Significa que Klarna está abandonando la IA?

No. Klarna mantiene su Agente de IA en producción manejando el grueso del volumen rutinario. Lo que cambió es que volvió a contratar humanos para los casos donde la IA mostró límites — disputas, reembolsos complejos, situaciones de hardship financiero. El nuevo modelo es híbrido: la IA hace lo que hace mejor, el humano interviene donde el costo del error sube.

¿Pasaría lo mismo en una empresa LATAM?

Sí, y de hecho lo vemos pasar todos los meses en escala más chica. Cuando una empresa LATAM decide reemplazar atención humana por un Agente de IA puro, el patrón es el mismo: deflection sube, CSAT promedio se mantiene, pero el % de re-contactos y la satisfacción en casos complejos se deterioran silenciosamente. La diferencia es que en LATAM el ciclo es más rápido por la cultura de atención más humana y la regulación de defensa del consumidor más activa.

¿Cuánto humano es "suficiente" en un modelo híbrido?

Depende del vertical, pero la regla operativa es que entre 15% y 30% de las conversaciones deberían escalar a humano en cualquier negocio con componente de compliance, financiero o emocional. Si tu deflection rate supera el 85% en cobranzas, atención de seguros o atención de salud, hay alta probabilidad de que estés escondiendo handoff fallidos en vez de evitándolos.

¿Qué métrica reemplaza al deflection rate como indicador de éxito?

Resolution rate ponderada por satisfacción a 24 horas. Es decir, qué porcentaje de conversaciones cerraron el problema del cliente Y a las 24 horas el cliente reporta satisfacción positiva. Esa métrica es más difícil de medir pero refleja el valor real del servicio. El deflection es una métrica operativa que solo funciona si está correlacionada con la resolución — y en muchos casos, no lo está.

¿Esto cambia con GPT-5 o con modelos open source como Llama 4?

Modelos más capaces resuelven más casos correctamente, pero no resuelven la lección estructural. Aunque GPT-5 redujera la tasa de hallucination al 1%, el cliente que cae en ese 1% sigue teniendo el peor experience de tu marca. La pregunta operativa no es "qué tan buena es la IA en promedio", sino "qué pasa con el cliente cuando la IA falla". Esa pregunta es arquitectónica, no del modelo.

¿Cómo evitar el error de Klarna desde el principio?

Tres reglas accionables. Primero, mide resolution rate y handoff quality desde el día uno, no solo deflection. Segundo, segmenta CSAT por complejidad del caso — el promedio agregado oculta problemas hasta que ya son visibles afuera. Tercero, mantén humanos en el circuito desde el inicio en cualquier caso con componente regulatorio o emocional. Reemplazo total funciona en casos rutinarios. Híbrido funciona en todo lo demás.

Conclusión

El caso Klarna se va a estudiar en escuelas de negocio durante años. No por la decisión de implementar IA — eso fue correcto y sigue siendo correcto — sino por la decisión de reemplazar humanos creyendo que el promedio del dashboard era equivalente a la experiencia del cliente. El promedio rara vez es la realidad de un cliente individual, y en atención al cliente el cliente individual es la unidad de negocio.

La buena noticia es que el error está documentado. El CEO admitió las palabras textuales. La curva de degradación se midió. La corrección de curso es pública. Las empresas que vienen ahora pueden aprender sin pagar el ticket de entrada.

Si tu empresa está hoy evaluando reemplazo total con IA, la decisión más estratégica que puedes tomar este trimestre es leer el caso Klarna en detalle, segmentar tus métricas por complejidad y ajustar tu arquitectura antes de ejecutar. La diferencia entre liderar el cambio y repetir el experimento es exactamente el tiempo que tardas en hacer ese análisis.

Sigue leyendo

- La paradoja de la automatización: por qué más IA exige más humanidad — el marco filosófico que predijo este reversal

- Las 3 capas de conocimiento de un Agente de IA — cómo definir guardrails sin perder fluidez

- Chatbot para cobranzas por WhatsApp en fintech — el cuadrante de mayor riesgo en LATAM

- Copilot para agentes: cómo la IA sugiere respuestas sin reemplazar al humano — el modelo que Klarna está implementando ahora

- Recuperar carritos abandonados por WhatsApp con IA — la arquitectura híbrida aplicada a un caso operacional concreto en eCommerce