Em fevereiro de 2024, o CEO da Klarna anunciou com orgulho que seu Agente de IA — desenvolvido com OpenAI — havia feito o trabalho de 700 agentes humanos no seu primeiro mês. Processou 2,3 milhões de conversas, reduziu o tempo de resolução de 11 minutos para menos de 2, e ia economizar para a fintech sueca 40 milhões de dólares em 2024. A cobertura tech foi eufórica. O CEO declarou publicamente que "a IA já pode fazer todos os trabalhos que nós humanos fazemos". 18 meses depois, a Klarna está voltando a contratar humanos.

Não por arrependimento moral. Por um problema de qualidade mensurável que o dashboard inicial não mostrava.

Este post não é uma coluna de opinião. É a análise operacional do que aconteceu dentro da Klarna, quais padrões do mesmo erro vemos se repetir em operações latino-americanas, e qual arquitetura concreta funciona na prática para evitar o mesmo destino. A razão pela qual merece um post próprio — e não apenas um parágrafo — é que o caso Klarna é o primeiro exemplo público e documentado de uma empresa que apostou "tudo na IA" no atendimento ao cliente, mediu os resultados com honestidade e reverteu a decisão. A indústria inteira está observando como esta história termina para decidir seu próximo movimento.

Ato 1: a promessa de fevereiro de 2024

No dia 27 de fevereiro de 2024, Klarna e OpenAI publicaram um comunicado conjunto. Os números do primeiro mês do Agente de IA em produção eram difíceis de ignorar:

- 2,3 milhões de conversas processadas em 30 dias

- Dois terços de todas as consultas de atendimento ao cliente

- Tempo médio de resolução: menos de 2 minutos, comparado com 11 minutos antes

- 25% menos consultas repetidas, indicando que as respostas resolviam no primeiro contato

- 23 mercados, 35+ idiomas desde o primeiro dia

- Impacto projetado: USD 40 milhões em melhoria de lucro para 2024

Brad Lightcap, COO da OpenAI naquele momento, selou com uma declaração: "A Klarna está na vanguarda entre nossos parceiros em adoção e aplicação prática de IA". Sebastian Siemiatkowski, CEO da Klarna, foi ainda mais longe em entrevistas: "A IA já pode fazer todos os trabalhos que nós humanos fazemos."

É importante entender por que a promessa era crível naquele momento. Os números iniciais eram reais. O bot estava funcionando. A satisfação média era comparável à dos agentes humanos. A Klarna não estava mentindo — estava apresentando os dados que tinha com a interpretação mais otimista possível.

O erro não esteve na apresentação. Esteve em qual dado se escolheu olhar.

Ato 2: a degradação silenciosa

O que o dashboard da Klarna mostrava era a média. O que escondia era a distribuição.

Quando uma empresa de serviços financeiros lida com 2,3 milhões de conversas por mês, a maioria dessas consultas é rotineira: "quanto devo?", "quando é a próxima parcela?", "como troco meu cartão?". Para essas perguntas, um Agente de IA bem construído responde melhor que um humano. É mais rápido, mais consistente, não se cansa, não se equivoca por distração. A Klarna não se equivocou nesse diagnóstico.

O problema começou a aparecer no que era estatisticamente invisível — os 5-10% dos casos complexos. Os reembolsos disputados. As cobranças incorretas. Os planos de pagamento em hardship. Os casos de fraude. As situações onde o cliente chega frustrado, com pouca margem emocional, e um detalhe mal respondido pode escalar para queixa regulatória.

Três padrões foram documentados nos meses seguintes:

Hallucinations em políticas de fees e reembolsos. O Agente de IA da Klarna respondia com segurança sobre termos que não tinham sido carregados corretamente, ou que tinham mudado entre versões. Em uma empresa de e-commerce, uma resposta incorreta sobre um cupom é um inconveniente. Em uma fintech, uma resposta incorreta sobre uma cobrança ou data de vencimento é um problema de compliance.

Queda de CSAT em casos complexos. A média se mantinha estável porque os casos rotineiros eram tantos que escondiam a deterioração. Mas quando se segmentava por complexidade, os casos que escalavam para humano depois de passar pelo bot mostravam níveis de satisfação significativamente piores que os que iam direto para humano. A razão: o cliente repetia toda a informação, sentia que o bot havia feito ele perder tempo, e chegava ao humano já bravo.

Aumento de Customer Effort Score. A métrica que mede quanto esforço custa ao cliente resolver seu problema começou a subir mês a mês. No início era atribuível à mudança. Quando a curva não se aplainou, ficou claro que era um padrão estrutural, não transitório.

O Better Business Bureau acumulou mais de 900 reclamações formais contra a Klarna em três anos, a maioria sobre temas de reembolso e faturamento — exatamente o quadrante onde uma resposta confiante mas incorreta faz mais dano que o silêncio.

Em meados de 2025, a equipe interna da Klarna começou a contratar agentes humanos novamente. Sem anúncio público. Sem contramarcha visível. Apenas uma correção de curso silenciosa.

Ato 3: o reversal

O silêncio terminou em maio de 2025. Siemiatkowski falou com a Bloomberg e disse, em frase que ficou como ponto de inflexão de toda uma época da indústria: "Fomos longe demais."

As palavras textuais do CEO nessa entrevista e as que se seguiram desenham um mapa do erro:

"Nos focamos demais no custo. O resultado foi menor qualidade."

"Da perspectiva de marca, da perspectiva da empresa, eu acho que é crítico que você seja claro com seu cliente: sempre vai haver um humano se você quiser."

O novo modelo que a Klarna anunciou não é um retorno ao call center tradicional. É híbrido. A empresa descreveu o formato como "estilo Uber": agentes humanos remotos com horários flexíveis, principalmente estudantes e pais com disponibilidade parcial, equipados com ferramentas de IA que os assistem em cada conversa. A IA continua gerenciando o grosso do volume rotineiro. Os humanos pegam o complexo, o emocional e o que requer julgamento.

É importante notar a diferença com a narrativa "a IA não serve". A Klarna não disse isso. A Klarna disse "a IA serve, mas não para tudo, e o custo de descobrir onde não serve resultou ser mais alto que o que economizamos". Essa distinção é a que define quais empresas vão sobreviver ao ciclo e quais vão estar fazendo o mesmo anúncio em 2027.

Por que aconteceu: os 3 erros estruturais

O caso Klarna não é um fracasso técnico. A tecnologia funcionou. O que falhou foi a lógica de avaliação. Três erros se repetem quando se analisa o que aconteceu.

Erro 1: confundir deflection com resolution

O deflection rate mede qual porcentagem de consultas não chega a um humano. O resolution rate mede qual porcentagem de problemas do cliente fica efetivamente resolvida. Não são a mesma coisa.

Um Agente de IA pode ter 85% de deflection e 60% de resolution. Isso significa que de cada 100 consultas, 85 não escalaram para humano — mas apenas 60 se resolveram. As outras 25 se fecharam sem resolver: o cliente desistiu, ou usou um canal alternativo, ou simplesmente abandonou.

O dashboard da Klarna mostrava deflection. A realidade do cliente era resolution. Quando os dois números divergem, o primeiro engana o segundo.

Erro 2: ignorar o paradoxo de Polanyi

Há 30 dias publicamos uma análise sobre o paradoxo da automação, inspirada na ideia do filósofo Michael Polanyi: "sabemos mais do que podemos dizer". Há conhecimento humano que não pode ser articulado em regras — saber ler a frustração de um cliente antes que ele a diga, perceber quando uma resposta correta é a resposta errada, ajustar o tom em tempo real.

A IA generativa capturou parte desse conhecimento tácito ao aprender de milhões de conversas. Mas capturou a camada superficial — os padrões de resposta. A camada profunda — o julgamento contextual — segue sendo humana. A Klarna automatizou a camada superficial acreditando que tinha automatizado tudo. A diferença se viu nos casos limite, que são justamente os que mais importam em uma fintech.

Erro 3: subestimar o custo das respostas confiantes mas erradas em compliance

Há indústrias onde uma resposta incorreta tem custo baixo. Se um Agente de IA de um serviço de delivery responde mal sobre o horário de atendimento, o cliente se incomoda e o caso se fecha. Há outras indústrias onde a mesma resposta incorreta pode gerar uma multa regulatória, uma reclamação formal ou um caso legal.

Cobranças em fintech, seguros, saúde, crédito ao consumo: todos são quadrantes onde a velocidade e a confiança com que o bot responde mal são proporcionalmente danosas. Na América Latina isso é amplificado pela regulação de Defesa do Consumidor — uma mensagem mal redigida pode ser usada como evidência em uma reclamação.

A Klarna está exatamente nesse quadrante. Buy now, pay later. Cobranças. Datas de vencimento. Disputas. A empresa escolheu a vertical de maior risco para fazer o experimento mais radical.

O que estamos vendo na América Latina

Como operadores de uma plataforma de atendimento ao cliente com centenas de contas ativas na América Latina, vemos o padrão Klarna se repetir em miniatura cada mês. É consistente o suficiente para descrevê-lo como um anti-padrão.

A sequência típica é esta. Uma empresa decide automatizar o atendimento. No primeiro trimestre, o deflection rate sobe de 60% para 85%. A equipe celebra. No segundo trimestre, alguém nota que o CSAT caiu 1,5 pontos mas está dentro da variância estatística. No terceiro trimestre, as queixas em redes sociais sobem. No quarto trimestre, a equipe de operações reporta que o % de re-contatos — o cliente que volta pelo mesmo problema — subiu 18 pontos. Para então, o custo da deterioração de marca já superou o que se economizou em headcount.

O que na Klarna aconteceu em escala global, em uma empresa latino-americana de 100 mil clientes acontece em escala local. A forma da curva é a mesma.

Há três particularidades regionais que vale a pena marcar:

Maior expectativa de "humano quando preciso". Na América Latina, a cultura de atendimento ao cliente tem uma fricção mais baixa com escalar para humano. O cliente argentino ou mexicano que vê o botão "falar com uma pessoa" o usa mais rápido que o europeu. Isso tem implicação operativa: se seu Agente de IA esconde o handoff, você o penaliza mais forte que em outros mercados.

Verticais de compliance mais expostos. Argentina e Brasil têm regulação de defesa do consumidor ativa. Uma conversa de WhatsApp com resposta incorreta sobre uma cobrança ou um pagamento pode ser apresentada como evidência formal. A barra de qualidade na resposta não é "satisfazer o cliente". É "não expor a empresa a uma multa".

Adoção acelerada de WhatsApp como canal principal. 80% das primeiras interações comerciais na América Latina ocorrem por mensageria. O erro da Klarna em chat web se amplifica no WhatsApp porque a conversa fica no telefone do cliente como evidência, capturável, compartilhável e reproduzível em redes sociais se sair mal.

As 3 lições operacionais

Se a Klarna nos deixou algo, são três regras acionáveis. As aplicamos em produção e as recomendamos a qualquer empresa que esteja avaliando hoje substituição total com IA.

Lição 1: o handoff é a métrica que define se seu Agente de IA funciona

Não o deflection. Não a velocidade. O handoff.

Um bom sistema híbrido se reconhece porque: (a) quando o bot escala para humano, faz isso com a conversa inteira transferida — o cliente não repete informação; (b) o SLA pós-handoff é realista, não "em breve"; (c) o agente humano vê o contexto, as sugestões do bot, e decide em segundos.

Se sua plataforma atual não te permite medir handoff timing, handoff completion rate e resolution rate pós-handoff, você está medindo o dashboard da Klarna em fevereiro de 2024.

Lição 2: híbrido > IA pura, em qualquer vertical com compliance ou emoção

Isto não é uma escolha filosófica. É uma escolha de risco. Uma IA pura é eficiente quando o custo do erro é baixo. Assim que o custo do erro sobe — multas regulatórias, dano de marca, abandono de cliente — o modelo híbrido domina.

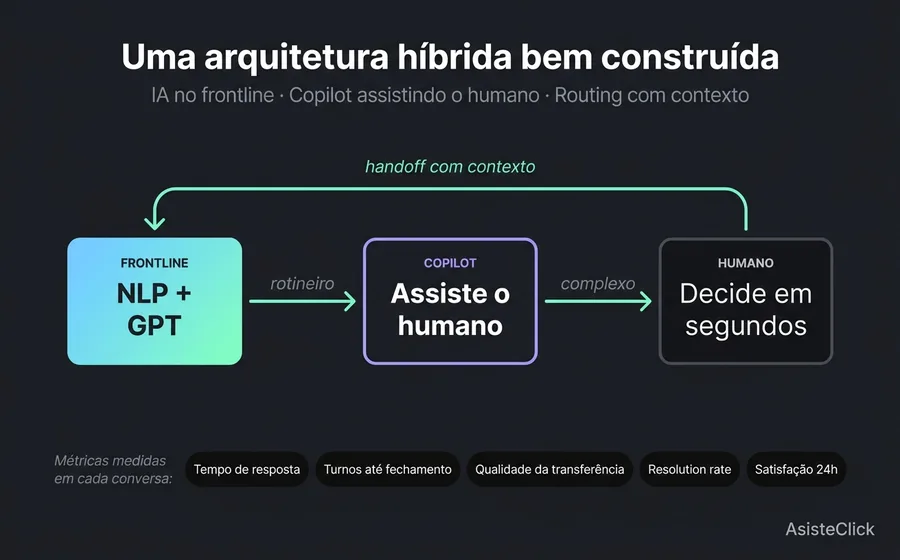

Na arquitetura que recomendamos, um módulo NLP gerencia fluxos previsíveis (consulta de saldo, agendamento, FAQs). Um módulo GPT com base de conhecimento própria gerencia consultas abertas que requerem entendimento contextual. Um Copilot assiste o agente humano quando a conversa escala. E uma caixa de entrada unificada com routing garante que o handoff seja instantâneo e com contexto preservado.

Lição 3: as verticais com compliance requerem guardrails específicos, não mais treinamento

Quando a resposta incorreta pode gerar uma multa, o problema não se resolve com "mais dados de treinamento". Se resolve com guardrails: respostas pré-aprovadas para temas de cobrança, fee, refund e disputa; escalation automática para humano quando aparecem palavras-chave de reclamação legal; logging total da conversa com timestamping para auditoria.

A arquitetura de três camadas de conhecimento — prompt oculto, base de conhecimento, interações específicas — é justamente o framework que permite definir esses guardrails sem que o bot perca fluência no não-sensível.

Como se vê um sistema híbrido bem construído

Para que a lição seja acionável, vale aterrissar a arquitetura. Um sistema híbrido bem feito tem três componentes e um protocolo.

Componente 1: o frontline automatizado. Aqui entra o grosso do volume. Consultas rotineiras, FAQs, processos transacionais conhecidos. Um módulo NLP cobre o previsível com precisão e velocidade. Um módulo GPT com base de conhecimento própria cobre o aberto mas delimitado ao domínio do negócio. O importante: este nível nunca gerencia o que tem risco de compliance sem escalation explícita.

Componente 2: o Copilot do agente humano. Quando a conversa escala, o humano que a recebe não entra às cegas. Vê a transcrição completa, um resumo automático do contexto, sugestões de resposta baseadas em casos similares anteriores, e dados do cliente carregados desde o CRM. A velocidade do humano híbrido se aproxima da do bot, mas com julgamento incorporado.

Componente 3: a caixa de entrada unificada com routing. O cliente não sabe — nem se importa — se a resposta veio do bot, do Copilot ou do humano puro. Para ele é uma conversa contínua. Por trás, o sistema rotea cada turno ao recurso correto: bot para perguntas conhecidas, humano para casos sensíveis, Copilot para humano assistido.

O protocolo: medição end-to-end. Cada conversa se mede em cinco pontos. (1) tempo até primeira resposta, (2) número de turnos até resolução ou handoff, (3) se houve handoff, qualidade do transfer (o cliente repetiu info?), (4) resolution rate ao fechamento, (5) satisfação a 24 horas pós-fechamento. Se algum desses cinco se degrada e os demais se mantêm, você já sabe onde está o problema.

Isso não é uma arquitetura conceitual. É o que está rodando hoje em contas latino-americanas com volumes mensais que vão desde 5 mil até 500 mil conversas.

Significa que a IA não serve?

Não. E vale dizê-lo claro porque a cobertura tech está oscilando do entusiasmo de 2024 ao pessimismo simétrico de 2026, e ambos os extremos são incorretos.

A IA generativa em atendimento ao cliente funciona. Resolve volumes que antes eram impensáveis. Reduz tempos de resposta de minutos para segundos. Permite oferecer atendimento 24/7 sem um custo operacional proibitivo. Captura conhecimento tácito e o distribui para a equipe.

O que não funciona é o modelo de substituição total. E não porque a IA seja ruim, mas porque o atendimento ao cliente não é só processamento de informação — é também gestão da confiança, da emoção e do risco. Quando uma empresa tenta automatizar esse segundo nível sem conservar humanos, o que se economiza em custos operacionais se perde em valor de marca e em exposição regulatória.

A Klarna não fracassou por usar IA. Fracassou por usá-la em vez de humanos em vez de junto com humanos. A diferença entre as duas preposições — "em vez de" vs "junto com" — é a diferença entre o comunicado de fevereiro de 2024 e a entrevista à Bloomberg em maio de 2025.

As empresas que vão liderar os próximos anos são as que aprenderam do experimento alheio antes de ter que pagar o seu.

Perguntas frequentes

Significa que a Klarna está abandonando a IA?

Não. A Klarna mantém seu Agente de IA em produção gerenciando o grosso do volume rotineiro. O que mudou é que voltou a contratar humanos para os casos onde a IA mostrou limites — disputas, reembolsos complexos, situações de hardship financeiro. O novo modelo é híbrido: a IA faz o que faz melhor, o humano intervém onde o custo do erro sobe.

Aconteceria o mesmo em uma empresa latino-americana?

Sim, e de fato vemos acontecer todos os meses em escala menor. Quando uma empresa latino-americana decide substituir atendimento humano por um Agente de IA puro, o padrão é o mesmo: deflection sobe, CSAT médio se mantém, mas o % de re-contatos e a satisfação em casos complexos se deterioram silenciosamente. A diferença é que na América Latina o ciclo é mais rápido pela cultura de atendimento mais humana e pela regulação de defesa do consumidor mais ativa.

Quanto humano é "suficiente" em um modelo híbrido?

Depende da vertical, mas a regra operacional é que entre 15% e 30% das conversas deveriam escalar para humano em qualquer negócio com componente de compliance, financeiro ou emocional. Se seu deflection rate supera os 85% em cobranças, atendimento de seguros ou atendimento de saúde, há alta probabilidade de que esteja escondendo handoff falhados em vez de evitando-os.

Qual métrica substitui o deflection rate como indicador de sucesso?

Resolution rate ponderada por satisfação a 24 horas. Ou seja, qual porcentagem de conversas fecharam o problema do cliente E a 24 horas o cliente reporta satisfação positiva. Essa métrica é mais difícil de medir mas reflete o valor real do serviço. O deflection é uma métrica operativa que só funciona se está correlacionada com a resolução — e em muitos casos, não está.

Isto muda com GPT-5 ou com modelos open source como Llama 4?

Modelos mais capazes resolvem mais casos corretamente, mas não resolvem a lição estrutural. Mesmo se o GPT-5 reduzisse a taxa de hallucination a 1%, o cliente que cai nesse 1% segue tendo o pior experience da sua marca. A pergunta operativa não é "quão boa é a IA em média", mas sim "o que acontece com o cliente quando a IA falha". Essa pergunta é arquitetônica, não do modelo.

Como evitar o erro da Klarna desde o princípio?

Três regras acionáveis. Primeiro, meça resolution rate e handoff quality desde o primeiro dia, não só deflection. Segundo, segmente CSAT por complexidade do caso — a média agregada oculta problemas até que já sejam visíveis fora. Terceiro, mantenha humanos no circuito desde o início em qualquer caso com componente regulatório ou emocional. Substituição total funciona em casos rotineiros. Híbrido funciona em todo o resto.

Conclusão

O caso Klarna vai ser estudado em escolas de negócio durante anos. Não pela decisão de implementar IA — isso foi correto e segue sendo correto — mas pela decisão de substituir humanos acreditando que a média do dashboard era equivalente à experiência do cliente. A média raramente é a realidade de um cliente individual, e em atendimento ao cliente o cliente individual é a unidade de negócio.

A boa notícia é que o erro está documentado. O CEO admitiu as palavras textuais. A curva de degradação foi medida. A correção de curso é pública. As empresas que vêm agora podem aprender sem pagar o ticket de entrada.

Se sua empresa está hoje avaliando substituição total com IA, a decisão mais estratégica que pode tomar este trimestre é ler o caso Klarna em detalhe, segmentar suas métricas por complexidade e ajustar sua arquitetura antes de executar. A diferença entre liderar a mudança e repetir o experimento é exatamente o tempo que você leva para fazer essa análise.

Continue lendo

- O paradoxo da automação: por que mais IA exige mais humanidade — o marco filosófico que previu este reversal

- As 3 camadas de conhecimento de um Agente de IA — como definir guardrails sem perder fluência

- Chatbot de cobranças por WhatsApp em fintech — o quadrante de maior risco na América Latina

- Copilot para agentes: como a IA sugere respostas sem substituir o humano — o modelo que a Klarna está implementando agora

- Recuperar carrinhos abandonados via WhatsApp com IA — a arquitetura híbrida aplicada a um caso operacional concreto em eCommerce