En février 2026, Gartner a publié une prédiction qui devrait déranger tout dirigeant ayant tout misé sur l'automatisation : la moitié des entreprises qui ont réduit leur personnel de service client grâce à l'IA vont réembaucher des personnes pour des fonctions similaires avant 2027. Ce n'est pas une spéculation marginale. C'est la société d'analyse la plus citée au monde, avec des données provenant de 321 leaders du service client, affirmant quelque chose qui contredit le récit dominant des trois dernières années.

L'histoire est plus profonde qu'il n'y paraît. Il ne s'agit pas de dire que l'intelligence artificielle ne fonctionne pas. Elle fonctionne. Le problème est qu'elle fonctionne si bien pour résoudre les tâches routinières qu'elle expose, avec une clarté brutale, tout ce qu'elle ne peut pas résoudre. Et ce "tout ce qu'elle ne peut pas résoudre" s'avère être exactement ce qui définit si un client reste ou part, s'il fait confiance ou se méfie, s'il recommande ou met en garde.

C'est le paradoxe de l'automatisation. Et le comprendre n'est pas un exercice philosophique : c'est la décision stratégique la plus importante qu'une entreprise de services puisse prendre en 2026.

Le paradoxe que personne n'avait anticipé

Il y a une idée qui traverse l'histoire de la technologie comme un fil invisible. Elle a été formulée par le philosophe hongro-britannique Michael Polanyi en 1966, bien avant l'existence de quelque chose de similaire à un chatbot : "Nous en savons plus que nous ne pouvons le dire." Polanyi faisait référence au savoir tacite — cette capacité humaine à faire des choses que nous ne pouvons pas expliquer avec des règles. Reconnaître un visage parmi des milliers. Percevoir qu'un client est frustré avant qu'il ne le dise. Savoir que cette conversation nécessite un ton différent.

Pendant des décennies, le paradoxe de Polanyi a été un obstacle à l'automatisation. Si vous ne pouvez pas articuler les règles, vous ne pouvez pas les programmer. Les chatbots basés sur des règles et les systèmes IVR fonctionnaient précisément dans cette limite : ils faisaient ce que vous pouviez spécifier, et rien de plus.

Mais l'intelligence artificielle générative a changé l'équation. Les modèles de langage n'ont pas besoin de règles explicites : ils apprennent des schémas de comportement humain à partir de millions d'exemples. Une étude de l'Université de Stanford et du MIT, publiée dans le NBER, a démontré qu'un outil d'IA entraîné avec les transcriptions des meilleurs agents d'un centre de contact a réussi à transférer ce savoir tacite au reste de l'équipe. Le résultat : une augmentation de productivité de 14 % en moyenne, et de 34 % chez les agents novices. Les agents avec deux mois d'expérience ont atteint le niveau de ceux qui avaient six mois, sans l'outil.

Et c'est là qu'apparaît le paradoxe. L'IA résout le savoir tacite opérationnel — le comment répondre, le quoi informations donner, le quand escalader. Mais en résolvant cela, elle révèle une couche plus profonde de savoir tacite qui reste exclusivement humaine : le jugement, l'empathie contextuelle, la capacité à lire entre les lignes. Plus la machine est compétente sur le plan technique, plus ce qui lui manque devient visible. Et ce qui lui manque est, paradoxalement, ce qui importe le plus.

Le cas Klarna : anatomie d'un excès

Si le paradoxe de l'automatisation avait besoin d'une étude de cas corporative, Klarna l'a fournie avec une générosité involontaire.

En 2024, la fintech suédoise a annoncé avec fierté que son chatbot d'IA — développé avec OpenAI — avait remplacé 700 agents de service client. Les chiffres initiaux semblaient valider la décision : le bot gérait 75 % des chats, traitant 2,3 millions de conversations en 35 langues. Le PDG, Sebastian Siemiatkowski, a transformé cette métrique en un slogan d'entreprise.

Ce qui n'a pas été mesuré — ou a été mesuré et ignoré — était ce qui se passait avec les 25% restants. Les interactions complexes. Les clients ayant des problèmes de remboursement qui ne correspondaient pas à des schémas prédéfinis. Les situations émotionnellement chargées où la vitesse du bot était perçue comme de l'indifférence. Les cas où le client avait besoin de sentir que quelqu'un le comprenait, pas que quelqu'un le traitait.

Début 2025, les métriques de satisfaction pour les interactions complexes s'étaient détériorées. Les clients signalaient des réponses robotiques, des scripts inflexibles, et ce qu'un analyste a décrit comme une "boucle kafkaïenne" : répéter le problème à un humain après l'échec du bot, comme si la première conversation n'avait jamais eu lieu.

En mai 2025, Siemiatkowski a publiquement admis : "Nous nous sommes trop concentrés sur l'efficacité et le coût. Le résultat a été une qualité inférieure." Pour 2026, Klarna réembauchait des agents humains selon un modèle hybride qu'ils ont appelé "style Uber" : des agents à distance avec des horaires flexibles, ciblant les étudiants et les parents.

L'arc narratif de Klarna est instructif non pas par son échec, mais par sa logique. L'entreprise n'a pas commis d'erreur technique. Elle a commis une erreur philosophique : elle a confondu la capacité de traiter avec la capacité de comprendre. Elle a automatisé la transaction, mais la transaction n'était que la surface de ce dont ses clients avaient besoin.

Ce que nous savons plus que ce que nous pouvons dire

Revenons à Polanyi, car son idée a des implications plus profondes que ce que l'industrie technologique lui accorde habituellement.

Lorsqu'un agent humain expérimenté parle à un client furieux, il fait quelque chose qu'aucun manuel de procédures ne peut entièrement saisir. Il lit des microsignaux : le rythme des mots, le choix des termes, le contexte implicite. Il ajuste son ton en temps réel, sans suivre un script d'"empathie" avec des phrases prédéfinies. Il prend une décision qui intègre des informations émotionnelles, contextuelles et opérationnelles d'une manière que même l'agent ne pourrait pas articuler si on lui demandait d'expliquer exactement ce qu'il a fait et pourquoi.

C'est ce que les chercheurs du MIT appellent le "knowledge spillover" — le déversement de connaissance tacite. Ce qui est fascinant dans l'étude Stanford-MIT, c'est que l'IA a réussi à capturer une partie de cette connaissance tacite opérationnelle et à la transférer. Mais la partie qu'elle a capturée est la couche la plus superficielle : les modèles de réponse, les séquences réussies, les structures de conversation. La couche profonde — celle qui distingue un agent qui résout d'un agent qui connecte — reste opaque pour la machine.

Sherry Turkle, professeure au MIT et auteure de "Alone Together", étudie depuis deux décennies la relation entre les humains et les machines. Sa conclusion est inconfortable pour l'industrie : les machines peuvent simuler l'intimité, mais la simulation ne produit pas la confiance. Elle produit, au mieux, du confort. Et au pire, ce qu'elle appelle "the uncanny valley of empathy" — cette sensation troublante que quelque chose prétend vous comprendre sans réellement le faire.

En service client, cette distinction n'est pas académique. Selon la Harvard Business Review, les clients établissent des liens émotionnels avec les marques à travers trois dimensions : la compétence, la chaleur et l'authenticité. L'IA excelle en compétence — elle est rapide, précise, disponible. Mais la chaleur et l'authenticité restent des territoires humains. Et ce qui est pertinent, c'est que les trois dimensions sont nécessaires. La compétence sans chaleur est une efficacité froide. La chaleur sans compétence est une bonne intention inutile. L'entreprise qui réussit les trois est celle qui fidélise.

Les chiffres qui soutiennent le paradoxe

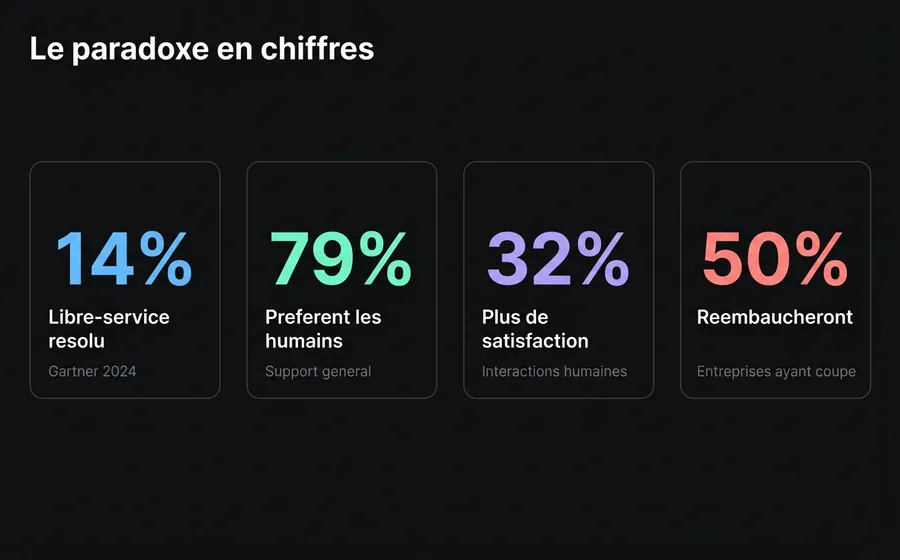

Le paradoxe de l'automatisation n'est pas une intuition. C'est une tendance documentée par des données convergentes provenant de multiples sources :

| Constat | Source | Année |

|---|---|---|

| Seuls 14% des problèmes de service sont entièrement résolus en libre-service | Gartner | 2024 |

| 79% des consommateurs préfèrent interagir avec un humain pour un support général | SurveyMonkey | 2026 |

| 89% estiment que les entreprises devraient toujours offrir la possibilité de parler à une personne | Enquête mondiale CX | 2025 |

| 78% déclarent qu'il est important de pouvoir passer d'un agent d'IA à un agent humain | Enquête mondiale CX | 2025 |

| Les interactions émotionnellement chargées résolues par des humains génèrent 32% de satisfaction en plus | McKinsey | 2025 |

| 91% des leaders du service client ressentent une pression pour implémenter l'IA | Gartner | 2026 |

| Seules 20% des organisations ont effectivement réduit leur effectif d'agents grâce à l'IA | Gartner | 2025 |

Lus ensemble, ces données racontent une histoire cohérente. Il y a une pression énorme pour automatiser (91% des leaders la ressentent). L'automatisation ne résout qu'une fraction du problème (14% de résolution complète en libre-service). Les clients continuent de vouloir des humains pour ce qui compte (79% de préférence). Et lorsque les entreprises réduisent leurs agents, la plupart finissent par le regretter.

La donnée la plus révélatrice est peut-être la plus simple : seuls 8% des consommateurs préfèrent l'IA à un humain en service client. Parmi ces 8%, les raisons sont la disponibilité (41%) et la rapidité (37%) — des avantages opérationnels, non relationnels. Personne ne dit "je préfère l'IA parce qu'elle me comprend mieux."

Le dernier mètre humain

En logistique, il existe le concept du "dernier kilomètre" — le tronçon final de livraison qui est, paradoxalement, le plus coûteux et le plus complexe de toute la chaîne. Arriver du centre de distribution à la porte de votre maison coûte plus cher que de déplacer le colis sur 5 000 kilomètres par avion.

En service client, il existe un équivalent que nous pourrions appeler le "dernier mètre humain." C'est le moment où la conversation cesse d'être un échange d'informations et devient une négociation émotionnelle. Le client n'a pas besoin de données. Il a besoin de sentir que son problème est important. Que la personne (ou l'entité) de l'autre côté a l'autorité et la volonté de le résoudre. Que ce n'est pas un cas, c'est une personne.

Ce dernier mètre est l'endroit où la fidélité se décide. Et c'est, par définition, là où l'IA a sa plus grande limitation. Non pas qu'elle ne puisse pas générer de phrases empathiques — elle le peut, et de mieux en mieux — mais parce que l'empathie sans conséquences n'est pas de l'empathie. C'est une simulation. Un humain peut dire "je vais résoudre cela personnellement" et cette phrase a du poids car il y a une personne derrière qui met sa réputation professionnelle en jeu. Quand un bot dit la même chose, c'est une chaîne de tokens optimisée pour produire de la satisfaction. Le client le sait. Parfois consciemment, parfois comme une intuition qu'il ne peut pas articuler.

L'ironie est que plus l'IA s'améliore dans la gestion des 80 % de tâches routinières, plus le niveau d'exigence est élevé pour les 20 % qui parviennent à un humain. Si le bot a résolu cinq questions simples de manière impeccable, le client s'attend à ce que l'agent humain qu'il finit par joindre soit exceptionnel. Pas juste bon. Exceptionnel. L'automatisation ne diminue pas le niveau d'exigence humain. Elle l'élève.

Trois erreurs stratégiques de la sur-automatisation

1. Confondre résolution et satisfaction

Un ticket peut être marqué comme "résolu" lorsque le bot a donné la bonne réponse. Mais résolution n'est pas synonyme de satisfaction, et satisfaction n'est pas synonyme de fidélité. Selon McKinsey, les interactions qui génèrent une connexion émotionnelle ont un impact sur la rétention 32 % supérieur à celles qui se contentent de résoudre le problème. L'entreprise qui ne mesure que le taux de résolution optimise une métrique tout en en érodant une autre, plus importante.

2. Automatiser avant de comprendre

Gartner a averti en 2026 que 40 % des projets d'IA agentique échoueront pour avoir tenté d'"automatiser des processus obsolètes". Vous ne pouvez pas automatiser un processus défectueux et espérer que l'IA le répare. Si votre flux d'escalade est confus avec des humains, il le sera avec des bots. Si vos catégories de support ne reflètent pas les problèmes réels de vos clients, un bot entraîné avec ces catégories reproduira la confusion plus rapidement.

L'IA amplifie ce qui existe déjà. S'il y a de la clarté opérationnelle, elle l'amplifie. S'il y a du chaos, elle l'amplifie aussi. Avant d'automatiser, il faut faire le travail humain de comprendre ce qui fonctionne et ce qui ne fonctionne pas.

3. Éliminer le contexte relationnel

Lorsqu'une entreprise remplace complètement une équipe de support humain, elle n'élimine pas seulement des agents. Elle élimine le réseau de connaissances informelles que ces agents avaient construit : qui est le client fréquent qui a toujours des problèmes de facturation, quel type de demandes se termine par une escalade, quel est le ton qui fonctionne avec le marché chilien par rapport à l'argentin. Cette connaissance ne se trouve dans aucune base de données. Elle vit dans l'expérience collective de l'équipe. Et une fois perdue, elle ne se récupère pas en entraînant un modèle.

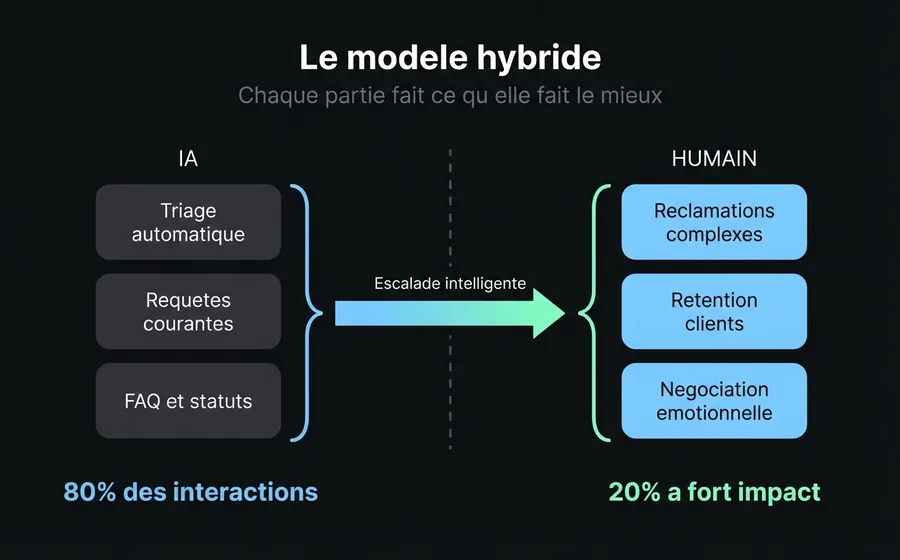

Le modèle hybride : ni tout humain, ni tout machine

Si les données convergent vers quelque chose, c'est ceci : l'avenir n'est pas l'IA contre les humains. C'est l'IA avec les humains, où chacun fait ce qu'il sait faire de mieux.

L'étude Stanford-MIT offre l'indice le plus concret. L'IA en tant qu'outil de coaching — et non de remplacement — a produit des améliorations mesurables : 14 % de productivité en plus, 25 % d'escalades en moins vers les superviseurs, meilleure rétention des employés. Le modèle fonctionne parce qu'il respecte le paradoxe : il utilise l'IA pour transférer des connaissances tacites opérationnelles, mais maintient l'humain au centre de l'interaction.

Gartner prévoit que d'ici 2026, 55 % des interactions de service client seront de type hybride IA-humain. Pas l'IA seule, pas l'humain seul : hybride. L'IA exécute avec précision, l'humain apporte son jugement. L'IA traite le contexte, l'humain interprète l'émotion. L'IA suggère la réponse, l'humain décide si elle est la bonne pour ce client, à ce moment, avec cette histoire.

Ce modèle exige un changement de mentalité. L'agent humain dans un système hybride n'est pas un opérateur qui suit des instructions. C'est un professionnel de la relation, équipé d'outils d'IA qui augmentent sa capacité. Son travail n'est pas de répondre plus vite — la machine l'a déjà fait. Son travail est de se connecter avec le client au moment qui compte, résoudre ce que la machine ne peut pas, et transformer un problème en une opportunité de fidélité.

Les plateformes qui comprennent cela ne conçoivent pas l'IA pour remplacer l'agent. Elles la conçoivent pour le renforcer: en suggérant des réponses, en résumant l'historique du client, en détectant le sentiment de la conversation en temps réel, et en le libérant des tâches répétitives afin qu'il puisse consacrer son énergie à la relation.

Implications pour les 18 prochains mois

L'IA invisible sera plus précieuse que l'IA visible

Les entreprises qui généreront le plus d'impact ne sont pas celles qui mettent un bot en avant et disent "parlez à notre IA." Ce sont celles qui intègrent l'IA de manière invisible dans le flux de travail de l'agent humain. Le client n'a pas besoin de savoir que la réponse a été suggérée par un modèle de langage. Il a besoin de savoir qu'il a été bien répondu, rapidement et avec discernement.

Les agents humains seront plus chers et plus précieux

Si l'IA gère 80% des requêtes routinières, les 20% restants exigent un niveau de compétence significativement plus élevé. Cela signifie que les entreprises doivent investir davantage dans la formation, et non moins. L'agent du futur n'est pas celui qui répond aux questions fréquentes — c'est le rôle du bot. C'est celui qui gère les conversations difficiles, retient les clients mécontents et transforme les plaintes en opportunités. Ce profil est plus rare et plus précieux.

La mesure va changer

Les métriques traditionnelles des centres de contact — temps moyen de résolution, tickets fermés par heure, taux de résolution au premier contact — sont conçues pour mesurer l'efficacité transactionnelle. Elles sont pertinentes, mais incomplètes. Les entreprises leaders mesureront également : le sentiment client post-interaction, le taux de rétention lié aux interactions humaines vs. automatisées, Net Promoter Score segmenté par type d'agent (humain, bot, hybride), et la valeur vie client (CLV) par canal de résolution.

Le modèle hybride sera la norme, pas l'exception

D'ici fin 2027, les entreprises opérant avec un modèle 100% automatisé ou 100% humain seront minoritaires. La norme sera un écosystème où l'IA effectue le triage, résout les tâches routinières, escalade les cas complexes, et l'humain intervient avec un contexte complet et des outils d'IA comme copilote. Les plateformes qui n'offriront pas cette architecture perdront de leur pertinence.

Questions fréquentes

L'IA va-t-elle remplacer les agents de service client ?

Pas de la manière prédite. Gartner estime que l'IA agéntique résoudra de manière autonome 80% des requêtes courantes d'ici 2029, mais le même Gartner prédit que la moitié des entreprises ayant réduit leurs effectifs d'agents réembaucheront avant 2027. Le modèle qui émerge est celui de la collaboration, non du remplacement : l'IA gère le routinier et l'humain se concentre sur le complexe et le relationnel.

Qu'est-ce que le paradoxe de l'automatisation dans le service client ?

C'est le phénomène par lequel l'automatisation des interactions routinières ne réduit pas le besoin d'humains, mais le transforme et l'élève. Plus l'IA est efficace pour résoudre des requêtes simples, plus le niveau de qualité attendu par les clients est élevé pour les interactions qui parviennent à un humain. L'automatisation n'élimine pas l'humain ; elle le rend plus visible et plus précieux.

Pourquoi la stratégie d'IA de Klarna a-t-elle échoué ?

Klarna a supprimé environ 700 agents de service client et les a remplacés par un chatbot d'IA en 2024. Bien que le bot ait traité 75% des chats avec succès, la satisfaction a chuté lors des interactions complexes. Le PDG Sebastian Siemiatkowski a admis que l'entreprise "s'était trop concentrée sur l'efficacité et les coûts." En 2026, ils réembauchaient des humains selon un modèle hybride. L'erreur n'était pas technique mais stratégique : ils ont confondu la capacité de traiter avec la capacité de comprendre.

Dans quelle mesure les consommateurs préfèrent-ils le support humain à l'IA ?

79% des consommateurs préfèrent interagir avec un humain pour un support général. Seulement 8% préfèrent l'IA aux humains, et leurs raisons sont opérationnelles (disponibilité et rapidité), non relationnelles. Cependant, 51% préfèrent les bots pour un service immédiat sur des requêtes simples, ce qui confirme que le modèle optimal est hybride.

Que devrait automatiser une entreprise et que ne devrait-elle pas ?

Automatisez ce qui peut être résolu avec des informations et un processus clair (demandes de statut, FAQs, procédures standardisées). Maintenez des humains pour ce qui nécessite du jugement, une négociation émotionnelle ou un contexte relationnel (réclamations, rétention, ventes complexes, situations exceptionnelles). Le critère n'est pas "l'IA peut-elle le faire ?" mais "le client a-t-il besoin de sentir qu'il y a une personne ?" Si la réponse est oui, l'IA devrait être le copilote, pas le pilote.

Conclusion

Le paradoxe de l'automatisation n'est pas un problème technique qui se résout avec un modèle plus avancé. C'est une vérité sur la nature humaine : nous valorisons ce que nous ressentons comme authentique, et l'authenticité ne s'adapte pas avec des serveurs. L'IA est l'outil le plus puissant qui soit apparu dans le service client depuis des décennies. Mais comme tout outil puissant, sa valeur ne réside pas dans ce qu'il peut faire seul, mais dans la manière dont il amplifie ce que font les personnes.

Les entreprises qui mèneront les prochaines années ne sont pas celles qui automatisent le plus. Ce sont celles qui automatisent le mieux — libérant leurs équipes humaines des tâches répétitives afin qu'elles se concentrent sur ce qu'aucune machine ne peut reproduire : la capacité de faire sentir à un autre être humain que son problème est important.

Ce n'est pas du sentimentalisme. C'est de la stratégie. Et les données le confirment.